Apache Airflow で Zuora データを連携

Apache Airflow は、データエンジニアリングワークフローの作成、スケジューリング、モニタリングをサポートするツールです。 CData JDBC Driver for Zuora と組み合わせることで、Airflow からリアルタイムの Zuora のデータ を扱うことができます。 この記事では、Apache Airflow インスタンスから Zuora のデータ に接続してクエリを実行し、結果を CSV ファイルに保存する方法を説明します。

CData JDBC ドライバーは、最適化されたデータ処理機能を組み込んでおり、 リアルタイムの Zuora のデータ を扱う際に比類のないパフォーマンスを発揮します。複雑な SQL クエリを Zuora に発行すると、 ドライバーはフィルタや集計などのサポートされている SQL 操作を直接 Zuora にプッシュし、 サポートされていない操作(主に SQL 関数や JOIN 操作)は組み込みの SQL エンジンを使用してクライアント側で処理します。 また、組み込みの動的メタデータクエリ機能により、ネイティブのデータ型を使用して Zuora のデータ の操作・分析が可能です。

Zuora への接続を設定

組み込みの接続文字列デザイナー

JDBC URL の構築には、Zuora JDBC Driver に組み込まれている接続文字列デザイナーを使用できます。JAR ファイルをダブルクリックするか、コマンドラインから JAR ファイルを実行してください。

java -jar cdata.jdbc.zuora.jar

接続プロパティを入力し、接続文字列をクリップボードにコピーします。

Zuora はユーザー認証にOAuth 標準を使用しています。OAuth 認証ついて詳しくは、オンラインヘルプドキュメントを参照してください。

Tenant プロパティの設定

プロバイダへの有効な接続を作成するには、アカウントの設定と合致するテナント値を1つ選択する必要があります。以下は、利用可能なオプションのリストです。

- USProduction:リクエストはhttps://rest.zuora.com に送信されます。

- USAPISandbox:リクエストはhttps://rest.apisandbox.zuora.com に送信されます。

- USPerformanceTest:リクエストはhttps://rest.pt1.zuora.com に送信されます。

- EUProduction:リクエストはhttps://rest.eu.zuora.com に送信されます。

- EUSandbox:リクエストはhttps://rest.sandbox.eu.zuora.com に送信されます。

デフォルトではUSProduction テナントを使用します。

Zuora サービスの選択

データクエリとAQuA API の2つのZuora サービスを使用します。デフォルトでは、ZuoraService はAQuADataExport に設定されています。DataQuery

データクエリ機能は、非同期の読み取り専用SQL クエリを実行することで、Zuora テナントからのデータのエクスポートを実現します。 このサービスは、素早く軽量なSQL クエリでの使用を推奨します。制限

- フィルタ適用後の、テーブルごとの入力レコードの最大数: 1,000,000

- 出力レコードの最大数: 100,000

- テナントごとの、実行用に送信される同時クエリの最大数: 5

- テナントごとの、同時クエリの制限に達した後に実行用に送信され、キューに追加されるクエリの最大数: 10

- 1時間単位での、各クエリの最大処理時間: 1

- GB 単位での、各クエリに割り当てられるメモリの最大サイズ: 2

- Index Join を使用する際のインデックスの最大値。言い換えれば、Index Join を使用する際にWHERE 句で使われる一意の値に基づいた、左のテーブルから返されるレコードの最大数: 20.000

AQuADataExport

AQuA API のエクスポートは、すべてのオブジェクト(テーブル)のすべてのレコードをエクスポートするように設計されています。AQuA のクエリジョブには以下の制限があります。制限

- AQuA のジョブ内のクエリが8時間以上実行されている場合、ジョブは自動的に停止されます。

- 停止されたAQuA のジョブは3回再試行可能で、その後失敗として返されます。

クラスター環境やクラウドで JDBC ドライバーをホストする場合は、ライセンス(製品版またはトライアル版)とランタイムキー(RTK)が必要です。ライセンス(またはトライアル)の取得については、弊社営業チームにお問い合わせください。

以下は、JDBC 接続に必要な主なプロパティです。

| プロパティ | 値 |

|---|---|

| データベース接続 URL | jdbc:zuora:RTK=5246...;OAuthClientID=MyOAuthClientId;OAuthClientSecret=MyOAuthClientSecret;Tenant=USProduction;ZuoraService=DataQuery; |

| データベースドライバークラス名 | cdata.jdbc.zuora.ZuoraDriver |

Airflow で JDBC 接続を設定

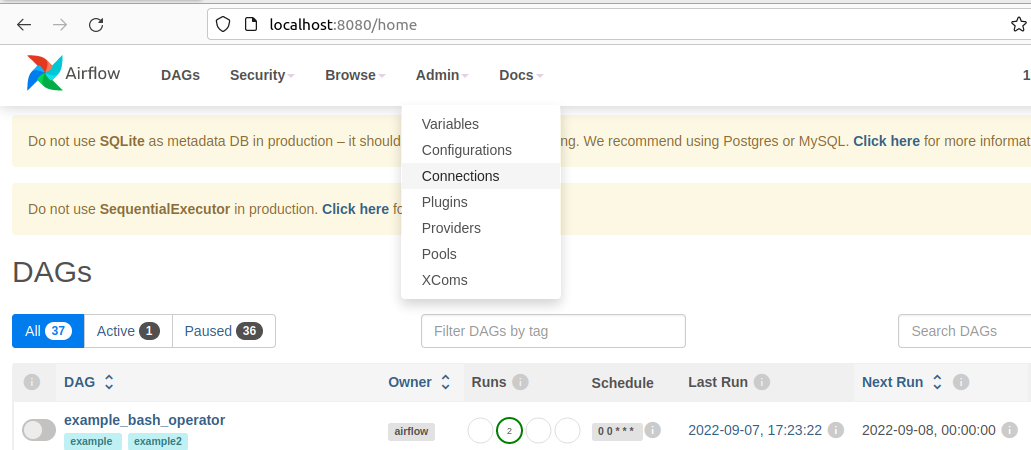

- Apache Airflow インスタンスにログインします。

- Airflow インスタンスのナビゲーションバーで、Admin にカーソルを合わせ、Connections をクリックします。

- 次の画面で + ボタンをクリックして、新しい接続を作成します。

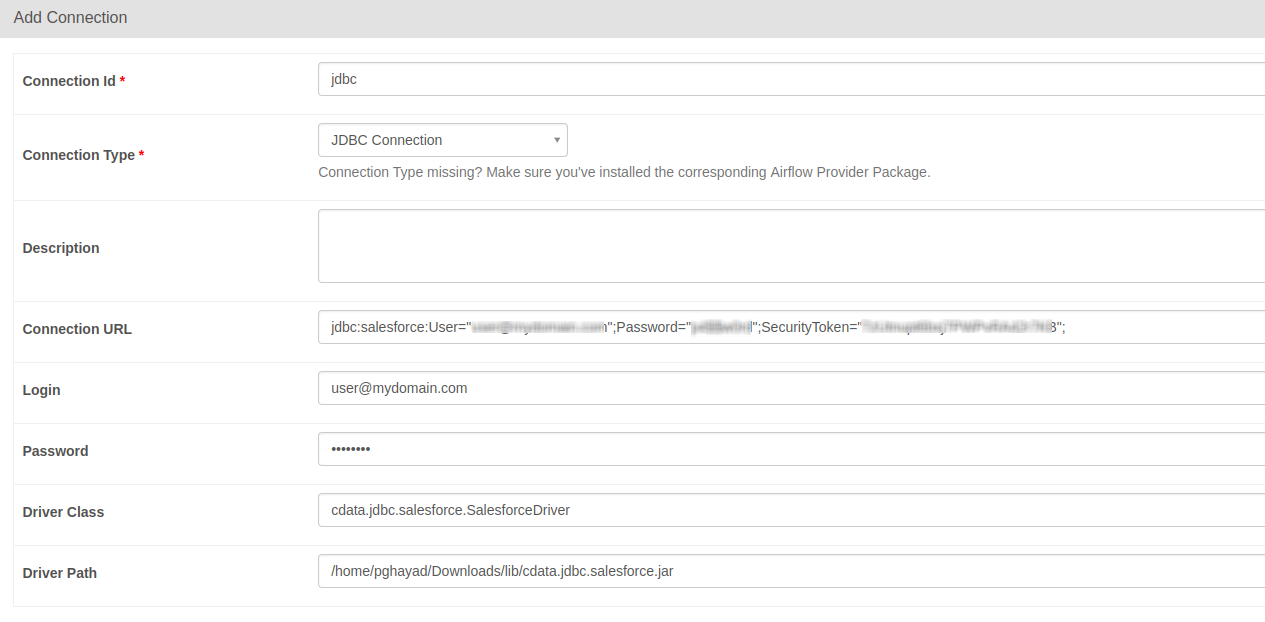

- Add Connection フォームで、必要な接続プロパティを入力します:

- Connection Id:接続の名前を入力します(例:zuora_jdbc)

- Connection Type:JDBC Connection

- Connection URL:上記の JDBC 接続 URL(例:jdbc:zuora:RTK=5246...;OAuthClientID=MyOAuthClientId;OAuthClientSecret=MyOAuthClientSecret;Tenant=USProduction;ZuoraService=DataQuery;)

- Driver Class:cdata.jdbc.zuora.ZuoraDriver

- Driver Path:PATH/TO/cdata.jdbc.zuora.jar

- フォーム下部の Test ボタンをクリックして、新しい接続をテストします。

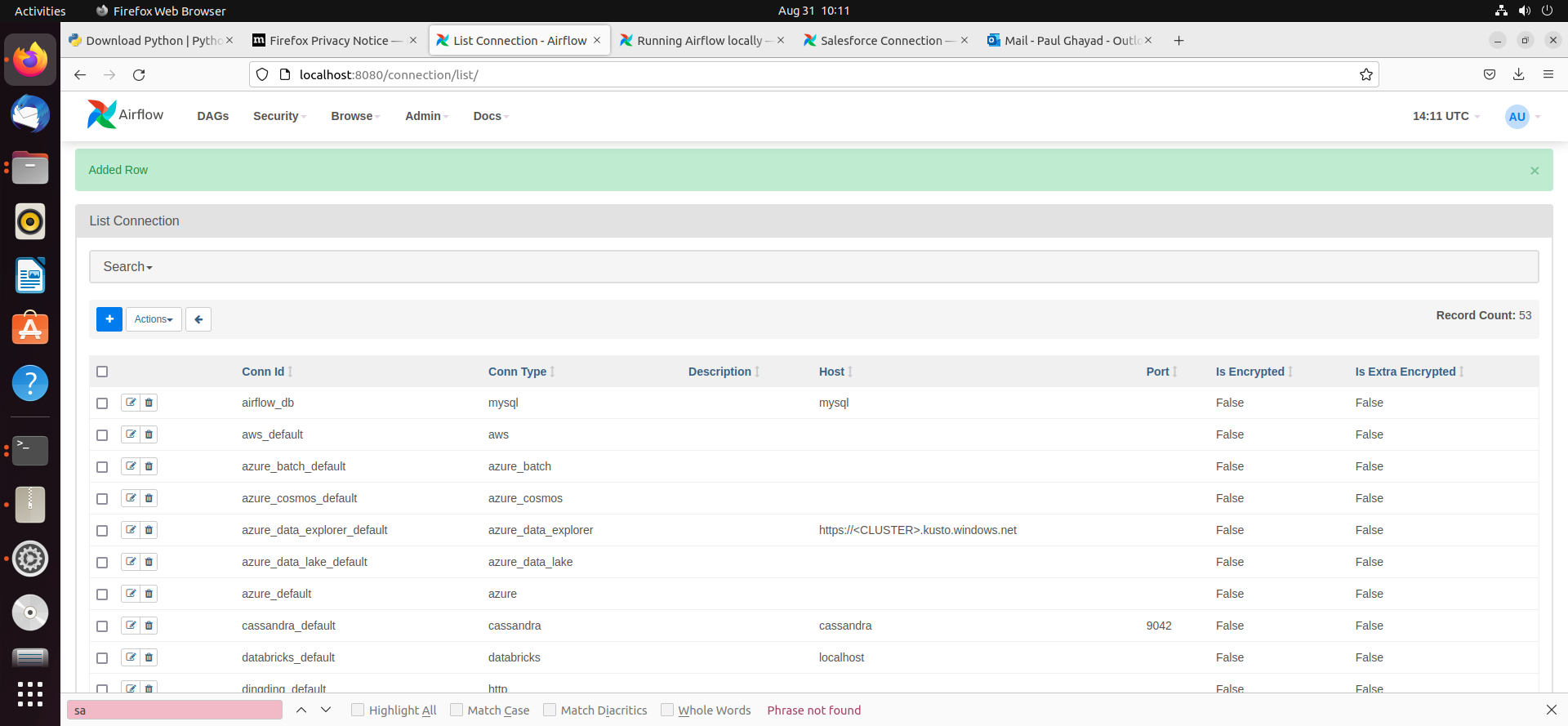

- 新しい接続を保存すると、次の画面で接続リストに新しい行が追加されたことを示す緑色のバナーが表示されます。

DAG の作成

Airflow の DAG は、ワークフローのプロセスを保存し、トリガーすることでワークフローを実行できるエンティティです。 ここでのワークフローは、Zuora のデータ に対して SQL クエリを実行し、結果を CSV ファイルに保存するというシンプルなものです。

- まず、ホームディレクトリに「airflow」フォルダがあるはずです。その中に「dags」という新しいディレクトリを作成します。 ここに Python ファイルを保存すると、UI 上で Airflow DAG として表示されます。

- 次に、新しい Python ファイルを作成し、zuora_hook.py という名前を付けます。このファイルに以下のコードを挿入してください:

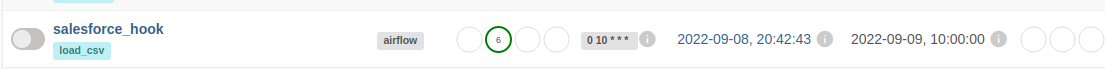

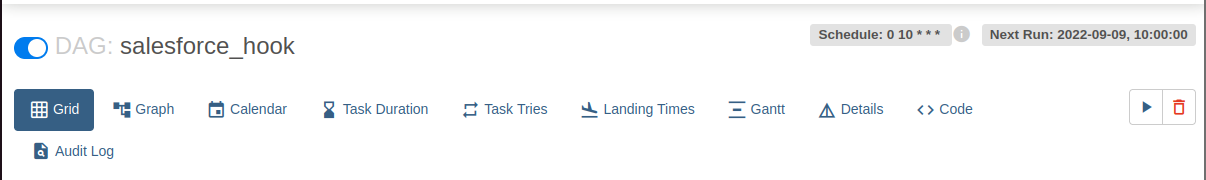

import time from datetime import datetime from airflow.decorators import dag, task from airflow.providers.jdbc.hooks.jdbc import JdbcHook import pandas as pd # DAG を宣言 @dag(dag_id="zuora_hook", schedule_interval="0 10 * * *", start_date=datetime(2022,2,15), catchup=False, tags=['load_csv']) # DAG 関数を定義 def extract_and_load(): # タスクを定義 @task() def jdbc_extract(): try: hook = JdbcHook(jdbc_conn_id="jdbc") sql = """ select * from Account """ df = hook.get_pandas_df(sql) df.to_csv("/{some_file_path}/{name_of_csv}.csv",header=False, index=False, quoting=1) # print(df.head()) print(df) tbl_dict = df.to_dict('dict') return tbl_dict except Exception as e: print("Data extract error: " + str(e)) jdbc_extract() sf_extract_and_load = extract_and_load() - このファイルを保存し、Airflow インスタンスを更新します。DAG のリストに「zuora_hook」という新しい DAG が表示されるはずです。

- この DAG をクリックし、次の画面で一時停止スイッチをクリックして青色にオンにします。次に、トリガー(再生)ボタンをクリックして DAG を実行します。これにより、zuora_hook.py ファイル内の SQL クエリが実行され、コード内で指定したファイルパスに CSV として結果がエクスポートされます。

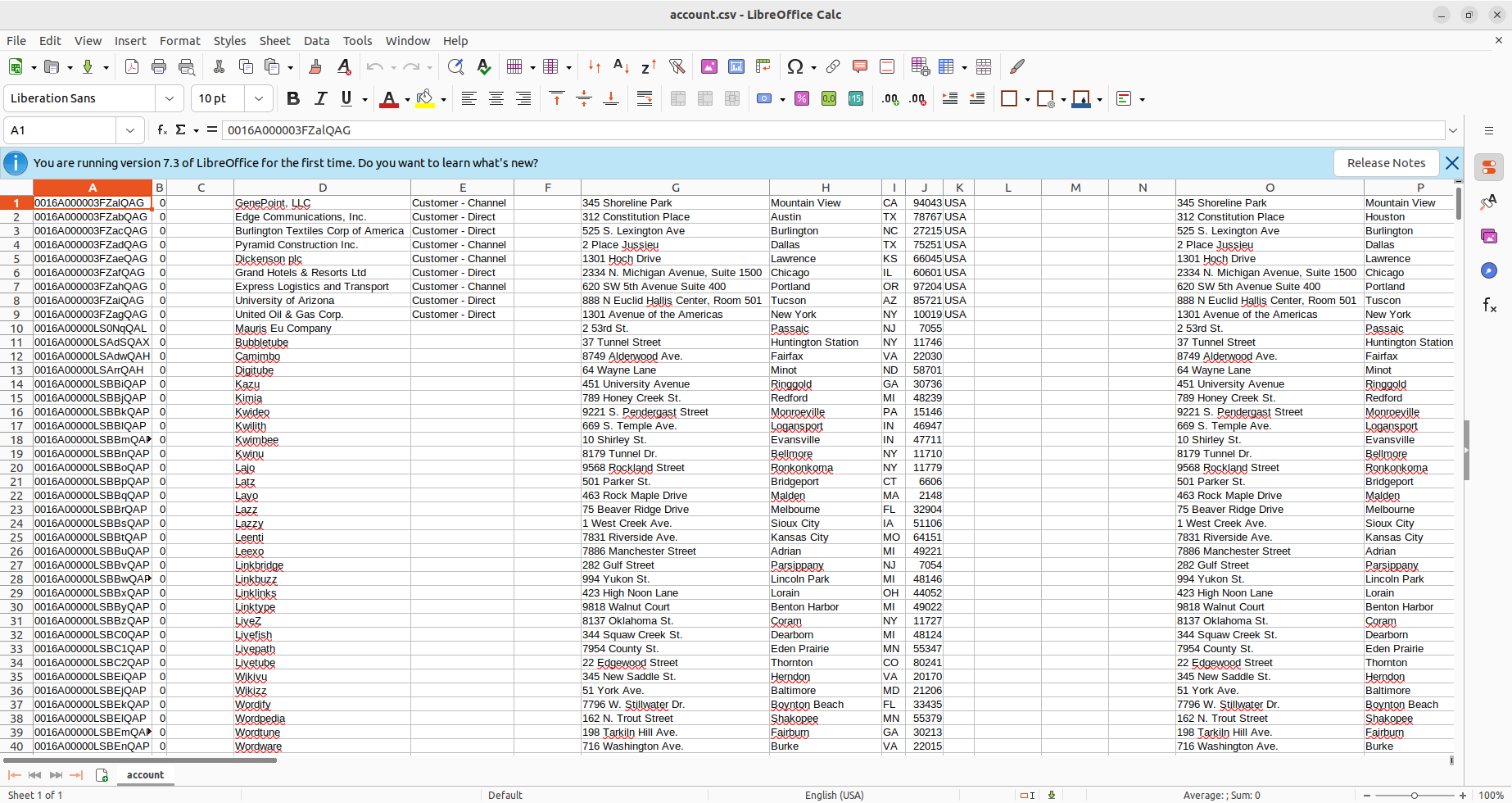

- 新しい DAG をトリガーした後、Downloads フォルダ(または Python スクリプト内で指定した場所)を確認すると、CSV ファイルが作成されていることがわかります。この例では account.csv です。

- CSV ファイルを開くと、Apache Airflow によって Zuora のデータ が CSV 形式で利用可能になっていることを確認できます。