Azure Databricks でSingleStore のデータに接続してデータ処理を行う方法

Databricks は、Apache Spark によるデータ処理機能を提供するクラウドベースのサービスです。CData JDBC ドライバと組み合わせることで、Databricks を使用してリアルタイムSingleStore のデータのデータエンジニアリングとデータサイエンスを実行できます。この記事では、Azure で CData JDBC ドライバをホストし、Databricks からリアルタイムSingleStore のデータに接続してデータを処理する方法を説明します。

最適化されたデータ処理機能を組み込んだ CData JDBC ドライバは、リアルタイムSingleStore のデータとのインタラクションにおいて卓越したパフォーマンスを発揮します。SingleStore に対して複雑な SQL クエリを発行すると、ドライバーはフィルタや集計などのサポートされている SQL 操作を直接SingleStoreにプッシュし、サポートされていない操作(主に SQL 関数や JOIN 操作)は組み込みの SQL エンジンを使用してクライアント側で処理します。動的メタデータクエリ機能により、ネイティブのデータ型を使用してSingleStore のデータの操作・分析が可能です。

CData JDBC ドライバを Azure にインストール

Databricks でリアルタイムSingleStore のデータを操作するには、Azure Data Lake Storage(ADLS)を通じてドライバーをインストールします。(以前のバージョンの記事で説明していた DBFS を介した接続方法は非推奨となっていますが、廃止日は公開されていません。)

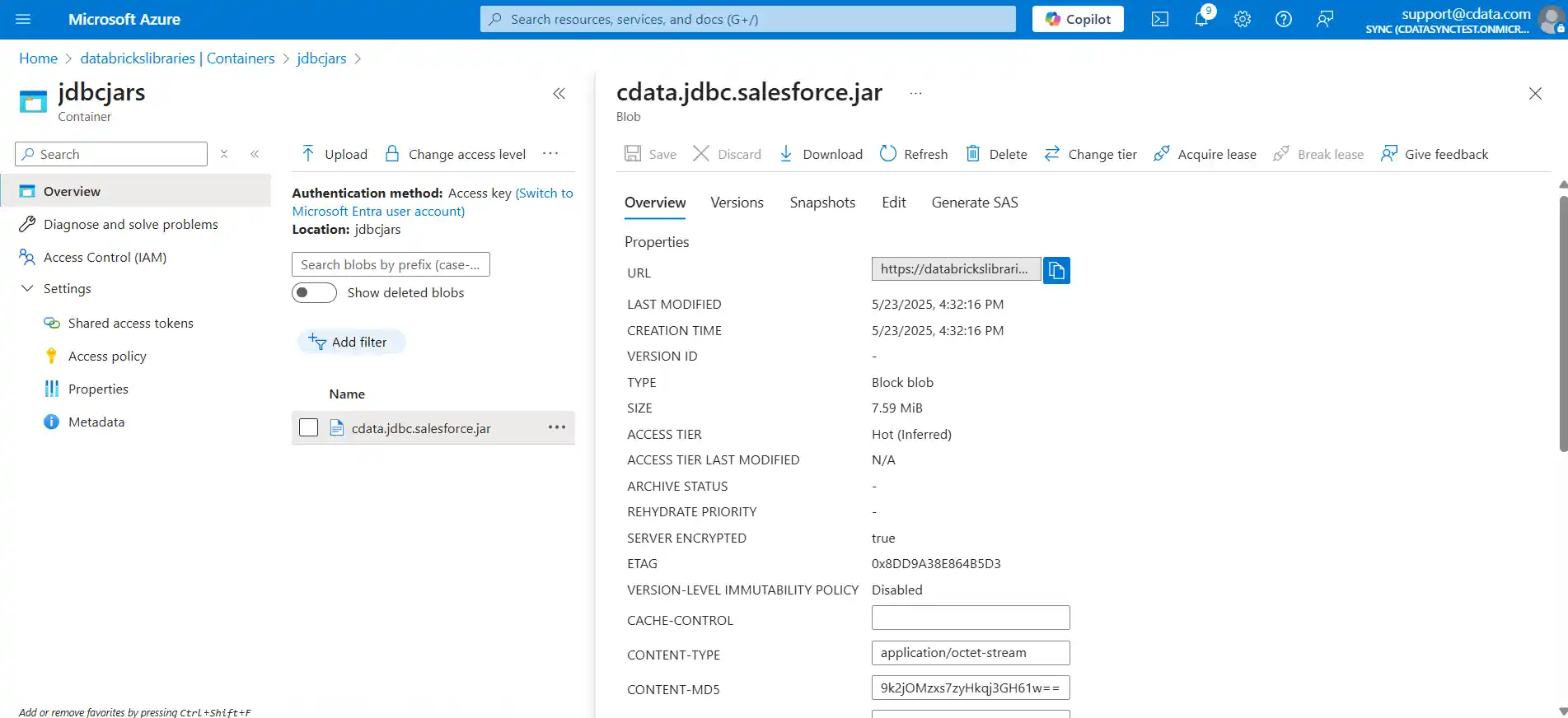

- JDBC JAR ファイルを任意の Blob コンテナにアップロードします(例:「databrickslibraries」ストレージアカウントの「jdbcjars」コンテナ)。

- ストレージアカウントから「セキュリティとネットワーク」を展開し、「アクセスキー」をクリックしてアカウントキーを取得します。使用するキーを表示してコピーしてください。

- コンテナに移動し、JAR を保存している特定のコンテナを開き、JDBC JAR ファイルのエントリを選択して JAR ファイルの URL を取得します。ファイルの詳細が開き、URL をクリップボードにコピーするボタンがあります。この値は以下のようになります(「blob」の部分はストレージアカウントの種類によって異なる場合があります):

https://databrickslibraries.blob.core.windows.net/jdbcjars/cdata.jdbc.salesforce.jar

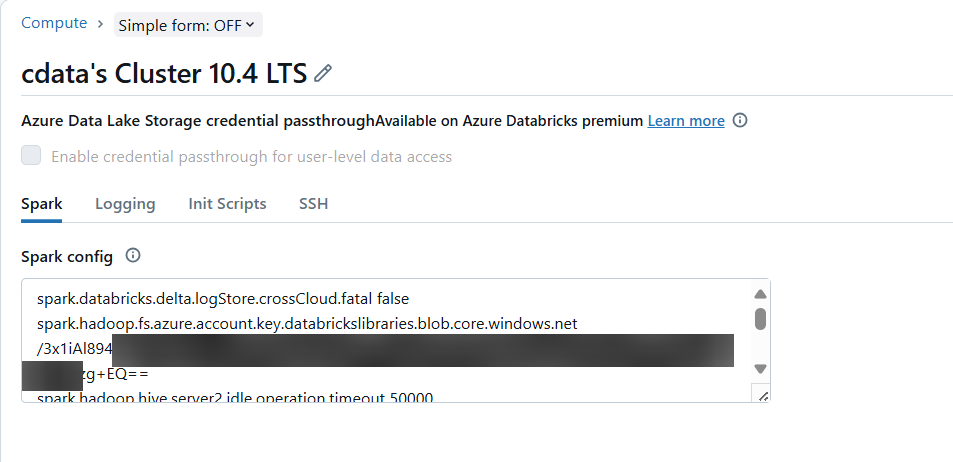

- Databricks クラスターの「Configuration」タブで「Edit」ボタンをクリックし、「Advanced options」を展開します。そこで、以下の Spark オプション(JAR URL のドメイン名から派生)に、コピーしたアカウントキーを値として追加し、「Confirm」をクリックします:

spark.hadoop.fs.azure.account.key.databrickslibraries.blob.core.windows.net

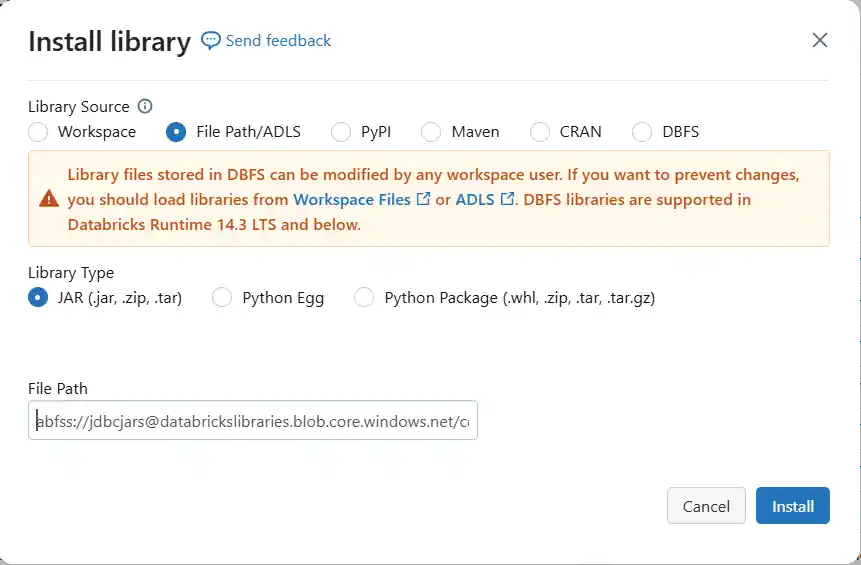

- Databricks クラスターの「Libraries」タブで「Install new」をクリックし、ADLS オプションを選択します。ドライバー JAR の ABFSS URL(これも JAR URL のドメイン名から派生)を指定し、「Install」をクリックします。ABFSS URL は以下のようになります:

abfss://jdbcjars@databrickslibraries.blob.core.windows.net/cdata.jdbc.salesforce.jar

Databricks からSingleStoreに接続

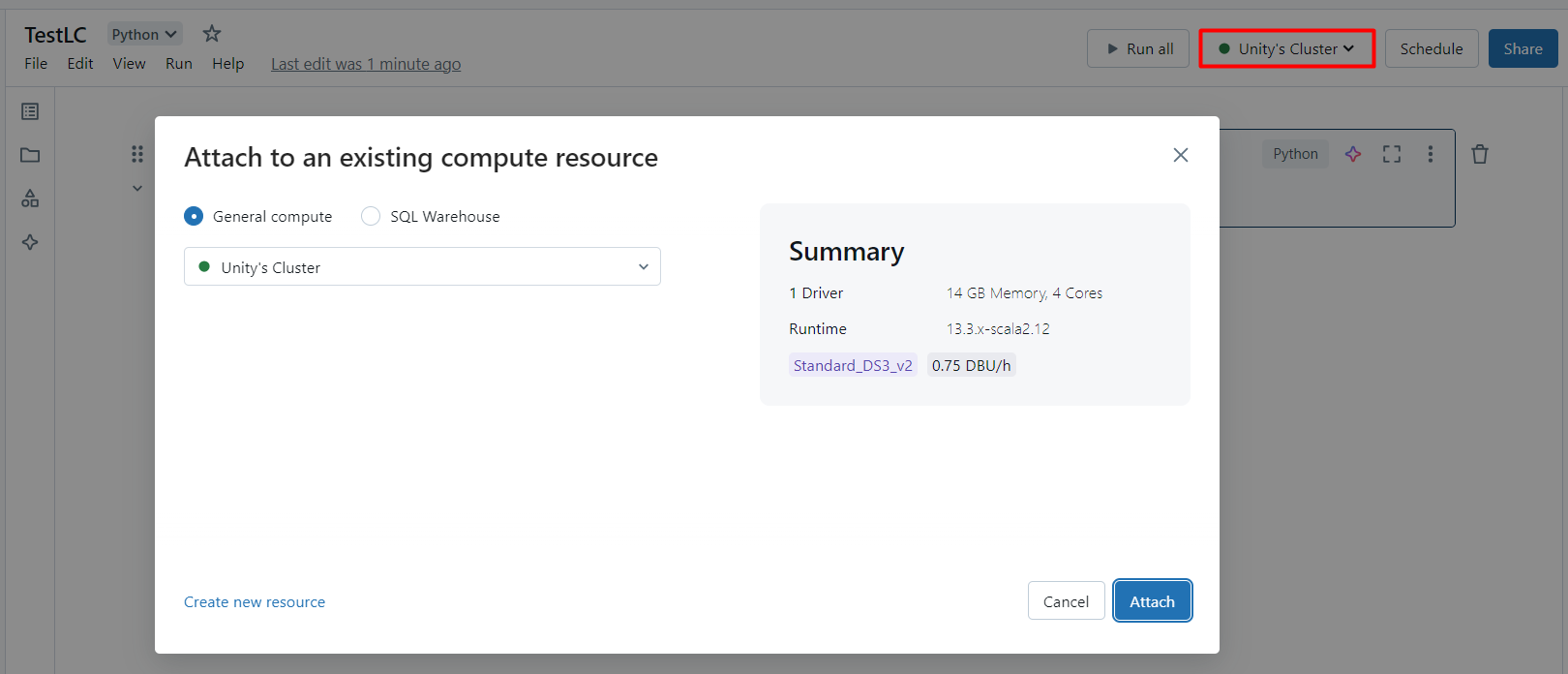

JAR ファイルがインストールされたら、Databricks でリアルタイムSingleStore のデータを操作する準備が整いました。まず、ワークスペースで新しいノートブックを作成します。ワークブックに名前を付け、言語として Python が選択されていることを確認し(デフォルトで選択されているはずです)、「Connect」をクリックして「General Compute」から JDBC ドライバーをインストールしたクラスターを選択します(デフォルトで選択されているはずです)。

SingleStoreへの接続を設定

JDBC ドライバのクラスを参照し、JDBC URL で使用する接続文字列を構築してSingleStoreに接続します。また、JDBC URL に RTK プロパティを設定する必要があります(Beta ドライバーを使用している場合を除く)。このプロパティの設定方法については、インストールに含まれるライセンスファイルを参照してください。

driver = "cdata.jdbc.singlestore.SingleStoreDriver" url = "jdbc:singlestore:RTK=5246...;User=myUser;Password=myPassword;Database=NorthWind;Server=myServer;Port=3306;"

組み込みの接続文字列デザイナー

JDBC URL の構築には、SingleStore JDBC Driver に組み込まれている接続文字列デザイナーを使用できます。JAR ファイルをダブルクリックするか、コマンドラインから JAR ファイルを実行してください。

java -jar cdata.jdbc.singlestore.jar

接続プロパティを入力し、接続文字列をクリップボードにコピーします。

データに接続するには、次の接続プロパティが必要です。

- Server:SingleStore データベースをホスティングしているサーバーのホスト名またはIP アドレス。

- Port:SingleStore データベースをホスティングしているサーバーのポート。

また、オプションで以下を設定することもできます。

- SingleStore:SingleStore Server に接続する場合のデフォルトデータベース。設定されていない場合、すべてのデータベースのテーブルが返されます。

標準認証

標準認証で認証するには、次を設定します。

- User:SingleStore サーバーに認証する際に使われるユーザー。

- Password:SingleStore サーバーに認証する際に使われるパスワード。

統合セキュリティを使用した接続

標準のユーザー名とパスワードを提供する代わりに、Windows 認証を介して信頼されたされたユーザーをサーバーに認証できます。

SSL 認証

SSL 認証を活用してセキュアなセッションを介してSingleStore データに接続できます。次の接続プロパティを設定し、データに接続します。

- SSLClientCert:クライアント証明書のための証明書ストア名に設定。クライアントとサーバーの両方のマシンでトラストストアとキーストアが保持される2-way SSL の場合に使用されます。

- SSLClientCertPassword:クライアント証明書ストアがパスワードで保護されている場合、この値をストアのパスワードに設定します。

- SSLClientCertSubject:TLS/SSL クライアント証明書のサブジェクト。ストア内の証明書を検索するために使用されます。

- SSLClientCertType:クライアントストアの証明書タイプ。

- SSLServerCert:サーバーが受け入れ可能な証明書。

SSH 認証

SSH を使用して、セキュアにリモートマシンにログインできます。SingleStore データにSSH 経由でアクセスするには、次の接続プロパティを設定します。

- SSHClientCert:クライアント証明書のための証明書ストア名に設定。

- SSHClientCertPassword:クライアント証明書ストアがパスワードで保護されている場合、この値をストアのパスワードに設定します。

- SSHClientCertSubject:TLS/SSL クライアント証明書のサブジェクト。ストア内の証明書を検索するために使用されます。

- SSHClientCertType:クライアントストアの証明書タイプ。

- SSHPassword:SSH サーバーに認証するためのパスワード。

- SSHPort:SSH 操作に使用するポート。

- SSHServer:認証しようとしているSSH 認証サーバー。

- SSHServerFingerPrint:接続先のホストの検証に使用するSSH サーバーのフィンガープリント。

- SSHUser:SSH サーバーに認証するためのユーザー名。

SingleStore のデータの読み込み

接続を設定したら、CData JDBC ドライバと接続情報を使用してSingleStore のデータをデータフレームとして読み込むことができます。

remote_table = spark.read.format ( "jdbc" ) \ .option ( "driver" , driver) \ .option ( "url" , url) \ .option ( "dbtable" , "Orders") \ .load ()

SingleStore のデータの表示

読み込んだSingleStore のデータを display 関数で確認してみましょう。

display (remote_table.select ("ShipName"))

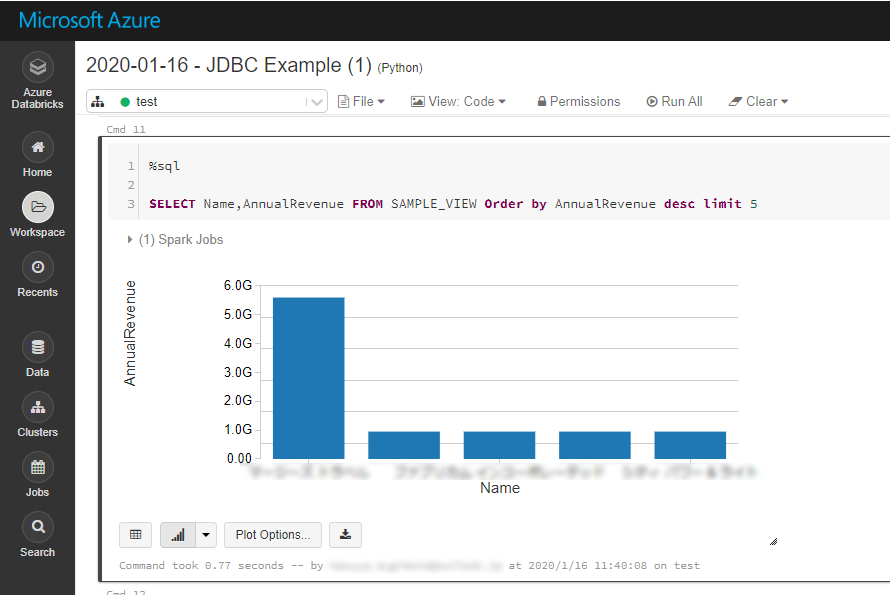

Azure Databricks でSingleStore のデータを分析

Databricks SparkSQL でデータを処理したい場合は、読み込んだデータを一時ビューとして登録します。

remote_table.createOrReplaceTempView ( "SAMPLE_VIEW" )

以下の SparkSQL で分析用のSingleStore のデータを取得できます。

result = spark.sql("SELECT ShipName, ShipCity FROM SAMPLE_VIEW WHERE ShipCountry = 'USA'")

SingleStore からのデータは、対象のノートブック内でのみ利用可能です。他のユーザーと共有したい場合は、テーブルとして保存してください。

remote_table.write.format ( "parquet" ) .saveAsTable ( "SAMPLE_TABLE" )

CData JDBC Driver for SingleStore の30日間の無償トライアルをダウンロードして、Azure Databricks でリアルタイムSingleStore のデータを活用してみてください。ご不明な点があれば、サポートチームまでお気軽にお問い合わせください。