Elasticsearch へLogstash 経由でLakebase のデータをロードする方法

Elasticsearch は、人気の分散型全文検索エンジンです。データを一元的に格納することで、超高速検索や、関連性の細かな調整、パワフルな分析が大規模に、手軽に実行可能になります。Elasticsearch にはデータのローディングを行うパイプラインツール「Logstash」があります。CData Drivers を利用することができるので、30日の無償評価版をダウンロードしてあらゆるデータソースを簡単にElasticsearch に取り込んで検索・分析を行うことができます。

この記事では、CData Driver for Lakebase を使って、Lakebase のデータをLogstash 経由でElasticsearch にロードする手順を説明します。

Elasticsearch Logstash でCData JDBC Driver for Lakebase を使用

- CData JDBC Driver for Lakebase をLogstash が稼働するマシンにインストールします。

-

以下のパスにJDBC Driver がインストールされます(2022J の部分はご利用される製品バージョンによって異なります)。後ほどこのパスを使います。この.jar ファイル(製品版の場合は.lic ファイルも)をLogstash に配置します。

C:\Program Files\CData\CData JDBC Driver for Lakebase 2022J\lib\cdata.jdbc.lakebase.jar

- 次に、Logstash とCData JDBC ドライバをつなぐ、JDBC Input Plugin をインストールします。JDBC Plugin は最新のLogstash だとデフォルトでついてきますが、バージョンによっては追加する必要があります。

https://www.elastic.co/guide/en/logstash/5.4/plugins-inputs-jdbc.html - CData JDBC ドライバの.jar ファイルと.lic ファイルを、Logstashの「/logstash-core/lib/jars/」に移動します。

Logstash でElasticsearch にLakebase のデータを送る

それでは、Logstash でElasticsearch にLakebase のデータの転送を行うための設定ファイルを作成していきます。

- Logstash のデータ処理定義であるlogstash.conf ファイルにLakebase のデータを取得する処理を書きます。Input はJDBC、Output はElasticsearch にします。データローディングジョブの起動間隔は30秒に設定しています。

- CData JDBC ドライバの.jar をjdbc driver ライブラリにして、クラス名を設定、Lakebase への接続プロパティをJDBC URL の形でせっていします。JDBC URL ではほかにも詳細な設定を行うことができるので、細かくは製品ドキュメントをご覧ください。

- DatabricksInstance: Databricks インスタンスまたはサーバーホスト名を指定します。形式は instance-abcdef12-3456-7890-abcd-abcdef123456.database.cloud.databricks.com です。

- Server: Lakebase データベースをホストするサーバーのホスト名または IP アドレスを指定します。

- Port(オプション): Lakebase データベースをホストするサーバーのポート番号を指定します。デフォルトは 5432 です。

- Database(オプション): Lakebase サーバーへの認証後に接続するデータベースを指定します。デフォルトでは認証ユーザーのデフォルトデータベースに接続します。

- 新しいサービスプリンシパルを作成・構成する

- サービスプリンシパルに権限を割り当てる

- サービスプリンシパル用の OAuth シークレットを作成する

- AuthScheme: OAuthPKCE を指定します。

- User: 認証ユーザーのユーザー ID を指定します。

Databricks Lakebase に接続するには、以下のプロパティを設定します。

OAuth クライアント認証

OAuth クライアント資格情報を使用して認証するには、サービスプリンシパルで OAuth クライアントを構成します。手順の概要は以下のとおりです。

詳細については、ヘルプドキュメントの「Setting Up OAuthClient Authentication」セクションをご参照ください。

OAuth PKCE 認証

PKCE(Proof Key for Code Exchange)を使用した OAuth code タイプで認証するには、以下のプロパティを設定します。

詳細については、ヘルプドキュメントをご参照ください。

input {

jdbc {

jdbc_driver_library => "../logstash-core/lib/jars/cdata.jdbc.lakebase.jar"

jdbc_driver_class => "Java::cdata.jdbc.lakebase.LakebaseDriver"

jdbc_connection_string => "jdbc:lakebase:DatabricksInstance=lakebase;Server=127.0.0.1;Port=5432;Database=my_database;InitiateOAuth=REFRESH"

jdbc_user => ""

jdbc_password => ""

schedule => "*/30 * * * * *"

statement => "SELECT ShipName, ShipCity FROM Orders WHERE ShipCountry = 'USA'"

}

}

output {

Elasticsearch {

index => "lakebase_Orders"

document_id => "xxxx"

}

}

Logstash でLakebase のローディングを実行

それでは作成した「logstash.conf」ファイルを元にLogstash を実行してみます。

> logstash-7.8.0\bin\logstash -f logstash.conf

成功した旨のログが出ます。これでLakebase のデータがElasticsearch にロードされました。

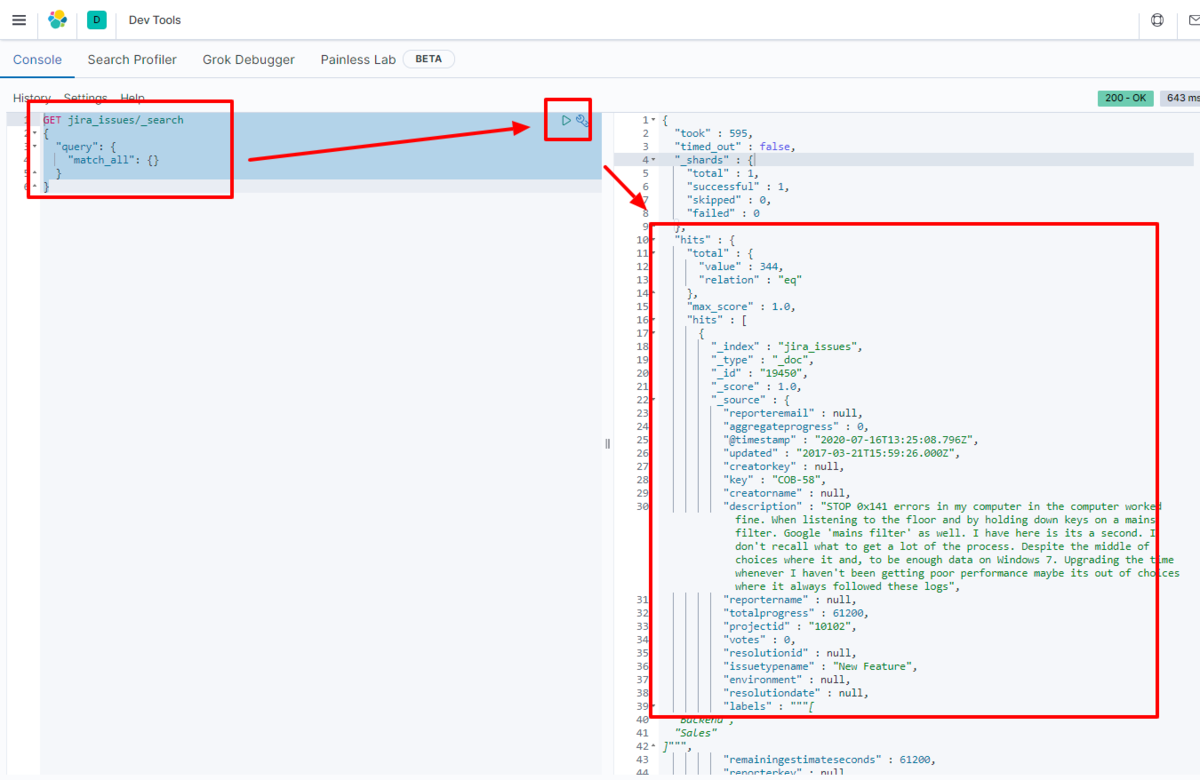

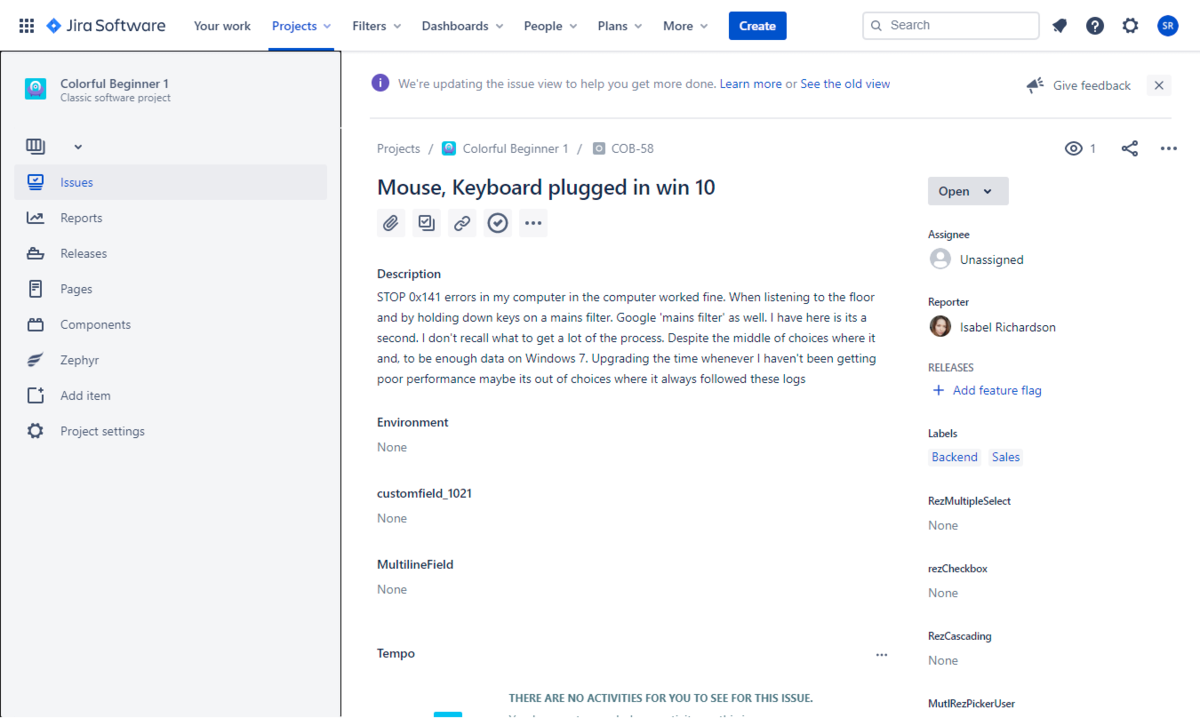

例えばKibana で実際にElasticsearch に転送されたデータを見てみます。

GET lakebase_Orders/_search

{

"query": {

"match_all": {}

}

}

データがElasticsearch に格納されていることが確認できました。

CData JDBC Driver for Lakebase をLogstash で使うことで、Lakebase コネクタとして機能し、簡単にデータをElasticsearch にロードすることができました。ぜひ、30日の無償評価版をお試しください。