Kafka のデータをApache Kafka トピックにストリーミング

Apache Kafka は、主にリアルタイムデータパイプラインやイベント駆動型アプリケーションの構築に使用されるオープンソースのストリーム処理プラットフォームです。CData JDBC Driver for Apache Kafkaと組み合わせることで、Kafka はライブのKafka のデータを扱うことができます。この記事では、Kafka データをApache Kafka トピックに接続、アクセス、ストリーミングする方法と、Confluent Control Center を起動してConfluent プラットフォームのKafka インフラストラクチャを使用して受信したKafka のデータをユーザーが安全に管理および監視できるようにする方法について説明します。

CData JDBC Driver は最適化されたデータ処理機能を内蔵しており、ライブのKafka のデータとのやり取りにおいて比類のないパフォーマンスを提供します。Kafka に複雑なSQL クエリを発行すると、ドライバーはフィルタや集計などのサポートされているSQL 操作を直接Kafka にプッシュし、サポートされていない操作(多くの場合SQL 関数やJOIN 操作)については組み込みのSQL エンジンを使用してクライアント側で処理します。組み込みの動的メタデータクエリにより、ネイティブのデータ型を使用してKafka のデータを操作および分析できます。

前提条件

Apache Kafka トピックでKafka のデータをストリーミングするためにCData JDBC Driver を接続する前に、クライアントのLinux ベースのシステムに以下をインストールおよび設定してください。

- Confluent Platform for Apache Kafka

- Confluent Hub CLI のインストール

- Confluent Platform 用のSelf-Managed Kafka JDBC Source Connector

Kafka のデータへの新しいJDBC 接続を定義

- Linux ベースのシステムにCData JDBC Driver for Apache Kafkaをダウンロードします。

- 以下の手順に従って新しいディレクトリを作成し、すべてのドライバーの内容を展開します:

- Kafka という名前の新しいディレクトリを作成します。

mkdir ApacheKafka

- ダウンロードしたドライバーファイル(.zip)をこの新しいディレクトリに移動します。

mv ApacheKafkaJDBCDriver.zip ApacheKafka/

- CData ApacheKafkaJDBCDriver の内容をこの新しいディレクトリに解凍します。

unzip ApacheKafkaJDBCDriver.zip

- Kafka という名前の新しいディレクトリを作成します。

- Kafka ディレクトリを開き、lib フォルダに移動します。

ls cd lib/

- CData JDBC Driver for Apache Kafka のlib フォルダの内容をKafka Connect JDBC のlib フォルダにコピーします。Kafka Connect JDBC フォルダの内容を確認し、cdata.jdbc.apachekafka.jar ファイルがlib フォルダに正常にコピーされたことを確認します。

cp -r /path/to/CData JDBC Driver for Apache Kafka/lib/* /usr/share/confluent-hub-components/confluentinc-kafka-connect-jdbc/lib/ cd /usr/share/confluent-hub-components/confluentinc-kafka-connect-jdbc/lib/

- 以下のコマンドを使用して、CData Kafka JDBC ドライバーのライセンスをインストールします。名前とメールアドレスを入力してください。

java -jar cdata.jdbc.apachekafka.jar -l

- プロダクトキーまたは"TRIAL" を入力します(ライセンスの有効期限が切れた場合は、CData サポートチームまでお問い合わせください)。

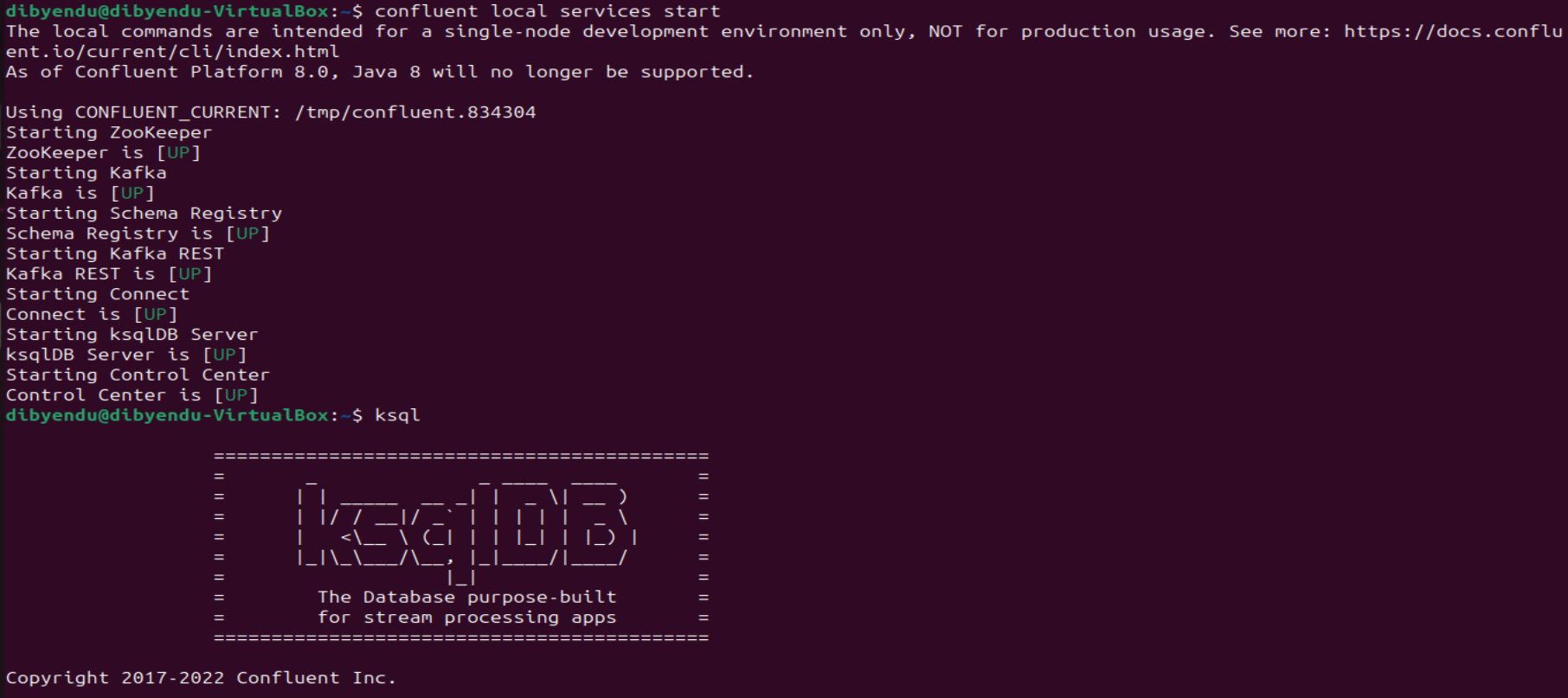

- 以下のコマンドを使用してConfluent ローカルサービスを起動します:

confluent local services start

これにより、Zookeeper、Kafka、Schema Registry、Kafka REST、Kafka CONNECT、ksqlDB、Control Center などのすべてのConfluent サービスが起動します。これで、CData JDBC Driver for Kafka を使用してKafka Connect Driver 経由でksqlDB のKafka トピックにメッセージをストリーミングする準備が整いました。

- POST HTTP API リクエストを使用してKafka トピックを手動で作成します:

curl --location 'server_address:8083/connectors' --header 'Content-Type: application/json' --data '{ "name": "jdbc_source_cdata_apachekafka_01", "config": { "connector.class": "io.confluent.connect.jdbc.JdbcSourceConnector", "connection.url": "jdbc:apachekafka:User=admin;Password=pass;BootStrapServers=https://localhost:9091;Topic=MyTopic;", "topic.prefix": "apachekafka-01-", "mode": "bulk" } }'HTTP POST 本文(上記)で使用されるフィールドについて説明します:

- connector.class: 使用するKafka Connect コネクタのJava クラスを指定します。

- connection.url: Kafka データに接続するためのJDBC 接続URL です。

組み込みの接続文字列デザイナー

JDBC URL の作成については、CData JDBC Driver for Apache Kafkaに組み込まれた接続文字列デザイナーを使用してください。JAR ファイルをダブルクリックするか、コマンドラインからjar ファイルを実行します。

java -jar cdata.jdbc.apachekafka.jar

接続プロパティを入力し、接続文字列をクリップボードにコピーします。

Apache Kafka 接続プロパティの取得・設定方法

それでは、Apache Kafka に接続していきましょう。.NET ベースのエディションは、Confluent.Kafka およびlibrdkafka ライブラリに依存して機能します。 これらのアセンブリはインストーラーにバンドルされており、CData 製品と一緒に自動的にインストールされます。 別のインストール方法をご利用の場合は、NuGet から依存関係のあるConfluent.Kafka 2.6.0をインストールしてください。

Apache Kafka サーバーのアドレスを指定するには、BootstrapServers パラメータを使用します。

デフォルトでは、CData 製品はデータソースとPLAINTEXT で通信しており、これはすべてのデータが暗号化なしで送信されることを意味します。 通信を暗号化したい場合は、以下の設定を行ってください:

- UseSSL をtrue に設定し、CData 製品がSSL 暗号化を使用するように構成します

- SSLServerCert およびSSLServerCertType を設定して、サーバー証明書をロードします

Apache Kafka への認証

続いて、認証方法を設定しましょう。Apache Kafka データソースでは、以下の認証方法をサポートしています:

- Anonymous

- Plain

- SCRAM ログインモジュール

- SSL クライアント証明書

- Kerberos

Anonymous 認証

Apache Kafka の特定のオンプレミスデプロイメントでは、認証接続プロパティを設定することなくApache Kafka に接続できます。 このような接続はanonymous(匿名)と呼ばれます。

匿名認証を行うには、以下のプロパティを設定してください。

- AuthScheme:None

その他の認証方法については、ヘルプドキュメントをご確認ください。

- topic.prefix: コネクタによって作成されるKafka トピックに追加されるプレフィックスです。「apachekafka-01-」に設定されています。

- mode: コネクタの動作モードを指定します。ここでは「bulk」に設定されており、コネクタがバルクデータ転送を実行するように設定されていることを示しています。

このリクエストにより、Kafka のすべてのテーブル/コンテンツがKafka トピックとして追加されます。

注意: リクエストをPOST するIP アドレス(サーバー)は、Linux ネットワークのIP アドレスです。

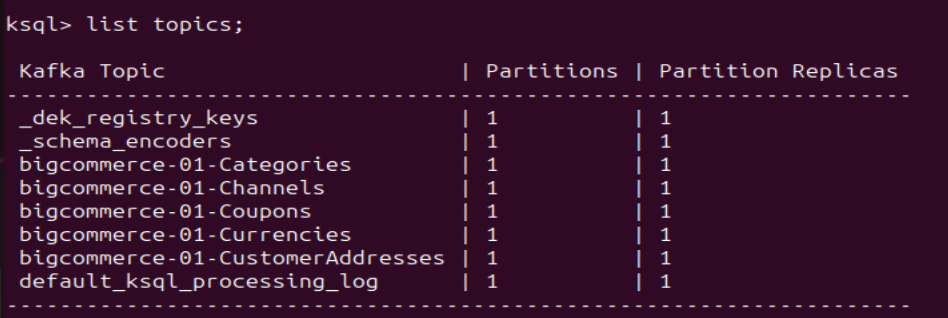

- ksqlDB を実行し、トピックを一覧表示します。以下のコマンドを使用します:

ksql list topics;

- トピック内のデータを表示するには、以下のSQL ステートメントを入力します:

PRINT topic FROM BEGINNING;

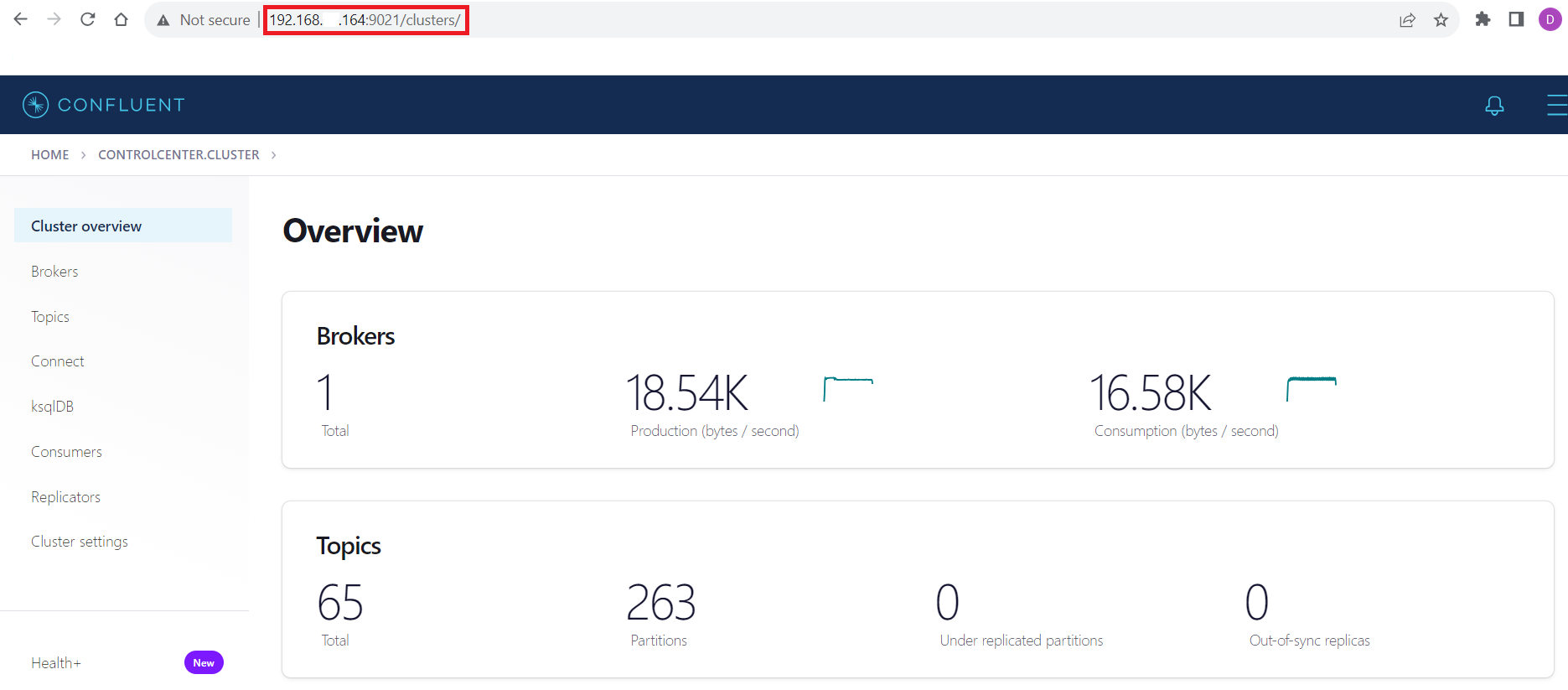

Confluent Control Center への接続

Confluent Control Center のユーザーインターフェースにアクセスするには、上記のセクションで説明した"confluent local services" を実行し、ローカルブラウザでhttp://<server address>:9021/clusters/ と入力してください。

おわりに

CData JDBC Driver for Apache Kafkaの30日間無償トライアルをダウンロードして、Kafka データをApache Kafka にストリーミングしましょう。ご不明な点があれば、サポートチームまでお問い合わせください。