Apache Spark でKafka のデータをSQL で操作する方法

Apache Spark は大規模データ処理のための高速エンジンです。CData JDBC Driver for ApacheKafka と組み合わせると、Spark はリアルタイムでKafka のデータに連携して処理ができます。本記事では、Spark シェルに接続してKafka をクエリする方法について解説します。

CData JDBC Driver は、最適化されたデータ処理がドライバーに組み込まれているため、リアルタイムKafka と対話するための高いパフォーマンスを提供します。Kafka に複雑なSQL クエリを発行すると、ドライバーはフィルタや集計など、サポートされているSQL操作を直接Kafka にプッシュし、組込みSQL エンジンを使用してサポートされていない操作(SQL 関数やJOIN 操作)をクライアント側で処理します。組み込みの動的メタデータクエリを使用すると、ネイティブデータ型を使用してKafka を操作して分析できます。

CData JDBC Driver for ApacheKafka をインストール

まずは、本記事右側のサイドバーからApacheKafka JDBC Driver の無償トライアルをダウンロード・インストールしてください。30日間無償で、製品版の全機能が使用できます。

Spark Shell を起動してKafka のデータに接続

- ターミナルを開き、Spark shell でCData JDBC Driver for ApacheKafka JAR file をjars パラメータに設定します:

$ spark-shell --jars /CData/CData JDBC Driver for ApacheKafka/lib/cdata.jdbc.apachekafka.jar

- Shell でJDBC URL を使ってKafka に接続し、SQL Context load() function でテーブルを読み込みます。

Apache Kafka 接続プロパティの取得・設定方法

それでは、Apache Kafka に接続していきましょう。.NET ベースのエディションは、Confluent.Kafka およびlibrdkafka ライブラリに依存して機能します。 これらのアセンブリはインストーラーにバンドルされており、CData 製品と一緒に自動的にインストールされます。 別のインストール方法をご利用の場合は、NuGet から依存関係のあるConfluent.Kafka 2.6.0をインストールしてください。

Apache Kafka サーバーのアドレスを指定するには、BootstrapServers パラメータを使用します。

デフォルトでは、CData 製品はデータソースとPLAINTEXT で通信しており、これはすべてのデータが暗号化なしで送信されることを意味します。 通信を暗号化したい場合は、以下の設定を行ってください:

- UseSSL をtrue に設定し、CData 製品がSSL 暗号化を使用するように構成します

- SSLServerCert およびSSLServerCertType を設定して、サーバー証明書をロードします

Apache Kafka への認証

続いて、認証方法を設定しましょう。Apache Kafka データソースでは、以下の認証方法をサポートしています:

- Anonymous

- Plain

- SCRAM ログインモジュール

- SSL クライアント証明書

- Kerberos

Anonymous 認証

Apache Kafka の特定のオンプレミスデプロイメントでは、認証接続プロパティを設定することなくApache Kafka に接続できます。 このような接続はanonymous(匿名)と呼ばれます。

匿名認証を行うには、以下のプロパティを設定してください。

- AuthScheme:None

その他の認証方法については、ヘルプドキュメントをご確認ください。

組み込みの接続文字列デザイナー

JDBC 接続文字列URL の作成には、Kafka JDBC Driver にビルトインされたデザイナを使用できます。JAR ファイルをダブルクリックするか、コマンドラインでJAR ファイルを実行するとデザイナが開きます。

java -jar cdata.jdbc.apachekafka.jar

接続プロパティを入力し、接続文字列をクリップボードにコピーします。

scala> val apachekafka_df = spark.sqlContext.read.format("jdbc").option("url", "jdbc:apachekafka:User=admin;Password=pass;BootStrapServers=https://localhost:9091;Topic=MyTopic;").option("dbtable","SampleTable_1").option("driver","cdata.jdbc.apachekafka.ApacheKafkaDriver").load() - 接続が完了し、データがロードされたら、テーブルスキーマが表示されます。

Kafka をテンポラリーテーブルとして登録します:

scala> apachekafka_df.registerTable("sampletable_1")-

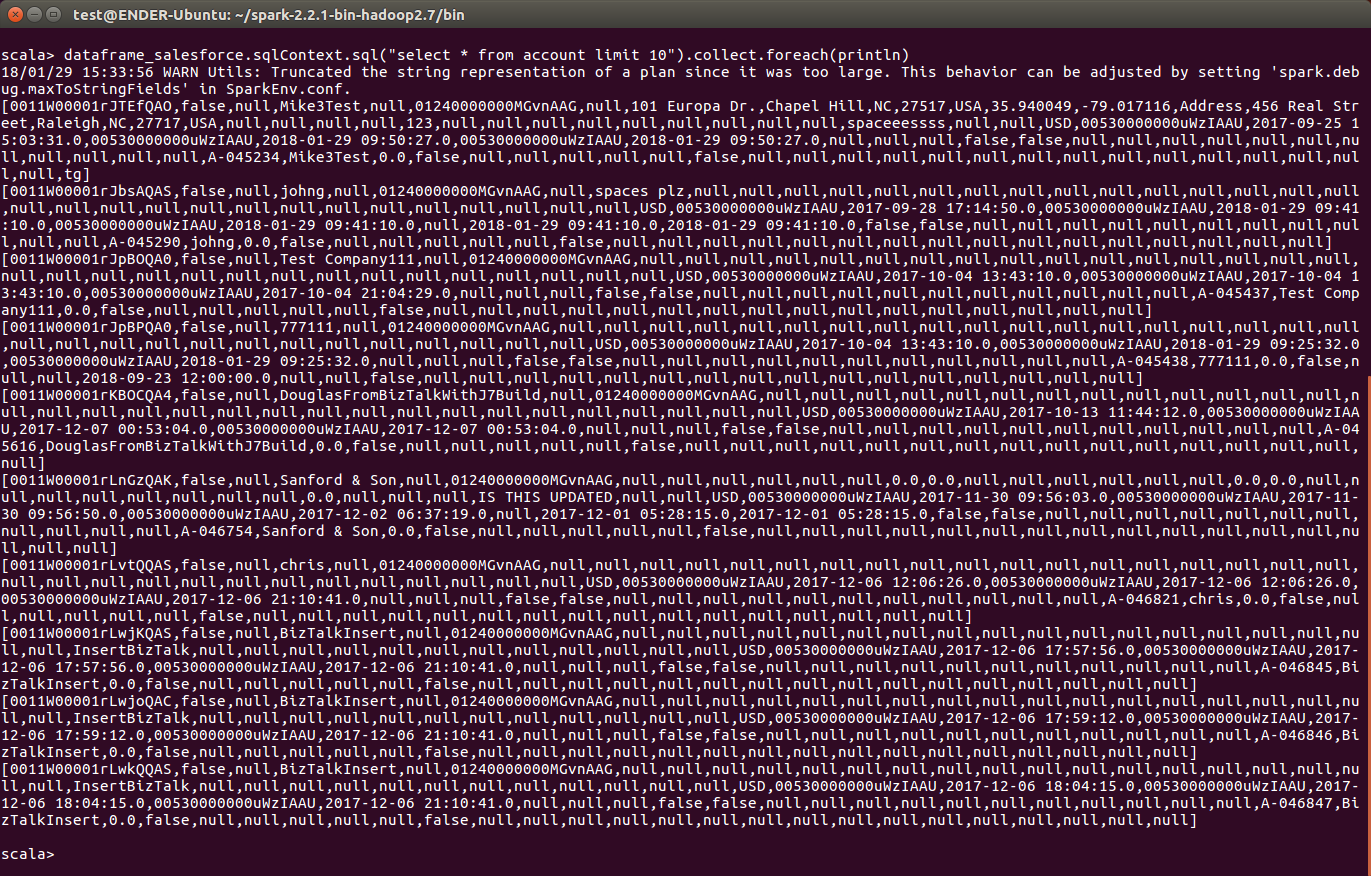

データに対して、次のようなカスタムSQL クエリを実行します。

scala> apachekafka_df.sqlContext.sql("SELECT Id, Column1 FROM SampleTable_1 WHERE Column2 = 100").collect.foreach(println)コンソールで、次のようなKafka のデータを取得できました!これでKafka との連携は完了です。

CData JDBC Driver for ApacheKafka をApache Spark で使って、Kafka に対して、複雑かつハイパフォーマンスなクエリを実行できます。30日の無償評価版 をダウンロードしてぜひお試しください。