Apache NiFi で Azure Data Lake Storage に接続

Apache NiFi は、強力かつスケーラブルなデータルーティング、変換、システム間連携ロジックの有向グラフをサポートしています。CData JDBC Driver for Azure Data Lake Storage と組み合わせることで、NiFi からリアルタイムのAzure Data Lake Storage のデータ を操作できます。この記事では、Apache NiFi Flow からAzure Data Lake Storage のデータ に接続してクエリを実行する方法を説明します。

CData JDBC Driver は、最適化されたデータ処理機能が組み込まれており、リアルタイムのAzure Data Lake Storage のデータ とのやり取りにおいて比類のないパフォーマンスを提供します。複雑なSQL クエリをAzure Data Lake Storage に発行すると、ドライバーはフィルタや集計などのサポートされているSQL 操作を直接Azure Data Lake Storage にプッシュし、サポートされていない操作(多くの場合SQL 関数やJOIN 操作)は組み込みのSQL エンジンでクライアント側に処理します。また、組み込みの動的メタデータクエリにより、ネイティブのデータ型を使用してAzure Data Lake Storage のデータ を操作・分析できます。

Apache NiFi でAzure Data Lake Storage のデータ に接続

- CData JDBC Driver for Azure Data Lake Storage のインストーラーをダウンロードし、パッケージを解凍して、.exe ファイルを実行してドライバーをインストールします。

CData JDBC Driver のJAR ファイル(およびライセンスファイルがある場合はそれも)、cdata.jdbc.adls.jar(および cdata.jdbc.adls.lic)を Apache NiFi の lib サブフォルダにコピーします(例:C:\nifi-1.3.0-bin\nifi-1.3.0\lib)。

Windows では、CData JDBC Driver のデフォルトのインストール場所は C:\Program Files\CData\CData JDBC Driver for Azure Data Lake Storage です。

bin サブフォルダにある run-nifi.bat ファイルを実行して Apache NiFi を起動します(例:C:\nifi-1.3.0-bin\nifi-1.3.0\bin)。

(または)

コマンドプロンプトで対象のディレクトリに移動し、run-nifi.bat ファイルを実行します:

cd C:\nifi-1.3.0-bin\nifi-1.3.0\bin .\run-nifi.bat

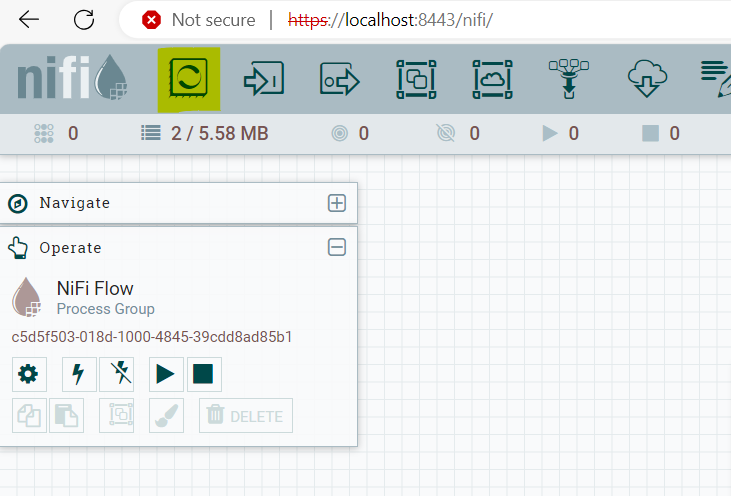

Web ブラウザで Apache NiFi の UI に移動します:https://localhost:8443/nifi でアクセスできます。

注意:古いバージョンの Apache NiFi を使用している場合は、http://localhost:8080/nifi からアクセスする必要があります。以前のバージョンでは HTTP プロトコルが使用されていましたが、最新バージョンでは HTTPS が標準になっています。デフォルトでは、HTTP はポート 8080 で動作し、HTTPS はポート 8443 を使用します。

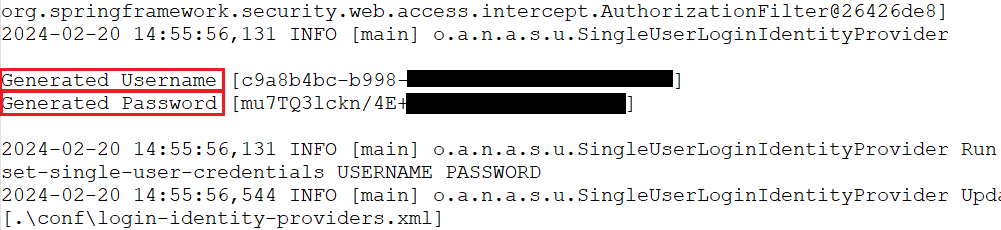

URL から Apache NiFi にアクセスすると、ログイン用のユーザー名とパスワードの入力を求められます。

ログイン資格情報を取得するには、NiFi のインストールディレクトリ内の log ディレクトリにある「App.log」ファイルを確認してください。このファイルには通常、NiFi インターフェースにアクセスするために必要な情報が含まれています。

- NiFi Flow のワークスペースを右クリックし、「Controller Services」をクリックします。

- ボタンをクリックして、新しいコントローラーサービスを作成します。

- Controller Services セクションで、新しく作成した「DBCPConnection Pool」を見つけ、メニュー()から「Edit」をクリックして新しい接続を設定します。

以下のプロパティを入力します:

- Database Connection URL:jdbc:adls:Schema=ADLSGen2;Account=myAccount;FileSystem=myFileSystem;AccessKey=myAccessKey;

- Database Driver Class Name:cdata.jdbc.adls.ADLSDriver

- Database Driver Location(s):Apache NiFi の lib フォルダへのパス(JAR ファイルが配置されている場所)。

組み込みの接続文字列デザイナー

JDBC URL の構築には、Azure Data Lake Storage JDBC Driver に組み込まれている接続文字列デザイナーを使用できます。JAR ファイルをダブルクリックするか、コマンドラインから JAR ファイルを実行してください。

java -jar cdata.jdbc.adls.jar

接続プロパティを入力し、接続文字列をクリップボードにコピーします。

Azure Data Lake Storage 接続プロパティの取得・設定方法

Azure Data Lake Storage Gen2 への接続

それでは、Gen2 Data Lake Storage アカウントに接続していきましょう。接続するには、以下のプロパティを設定します。

- Account:ストレージアカウントの名前

- FileSystem:このアカウントに使用されるファイルシステム名。例えば、Azure Blob コンテナの名前

- Directory(オプション):レプリケートされたファイルが保存される場所へのパス。パスが指定されない場合、ファイルはルートディレクトリに保存されます

Azure Data Lake Storage Gen2への認証

続いて、認証方法を設定しましょう。CData 製品では、5つの認証方法をサポートしています:アクセスキー(AccessKey)の使用、共有アクセス署名(SAS)の使用、Azure Active Directory OAuth(AzureAD)経由、Azure サービスプリンシパル(AzureServicePrincipal またはAzureServicePrincipalCert)経由、およびManaged Service Identity(AzureMSI)経由です。

アクセスキー

アクセスキーを使用して接続するには、まずADLS Gen2ストレージアカウントで利用可能なアクセスキーを取得する必要があります。

Azure ポータルでの手順は以下のとおりです:

- ADLS Gen2ストレージアカウントにアクセスします

- 設定でアクセスキーを選択します

- 利用可能なアクセスキーの1つの値をAccessKey 接続プロパティにコピーします

接続の準備ができたら、以下のプロパティを設定してください。

- AuthScheme:AccessKey

- AccessKey:先ほどAzure ポータルで取得したアクセスキーの値

共有アクセス署名(SAS)

共有アクセス署名を使用して接続するには、まずAzure Storage Explorer ツールを使用して署名を生成する必要があります。

接続の準備ができたら、以下のプロパティを設定してください。

- AuthScheme:SAS

- SharedAccessSignature:先ほど生成した共有アクセス署名の値

その他の認証方法については、 href="/kb/help/" target="_blank">ヘルプドキュメントの「Azure Data Lake Storage Gen2への認証」セクションをご確認ください。

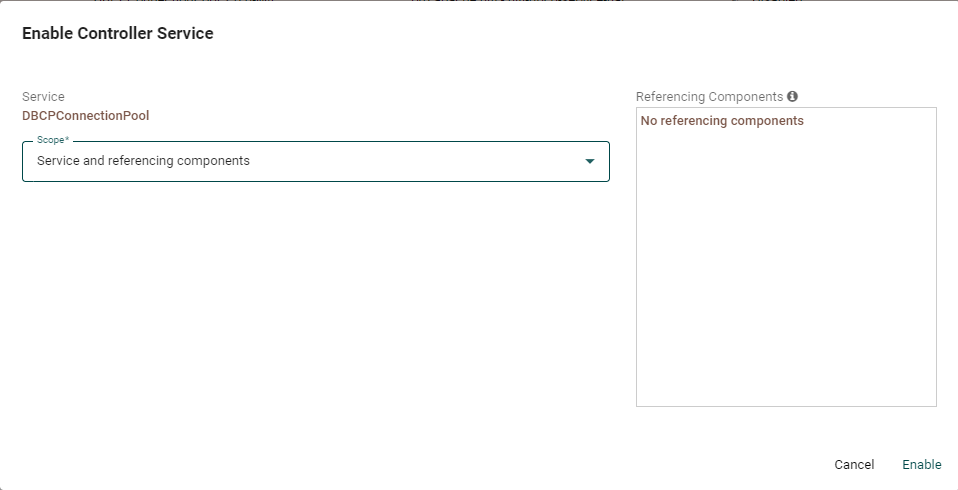

- Controller Services セクションで、新しく作成した DBCPConnection Pool を見つけ、メニュー()から「Enable」をクリックして新しい接続を有効にします。

- 「Enable Controller Service」ウィンドウで、Scope を「Service and referencing components」に設定します。

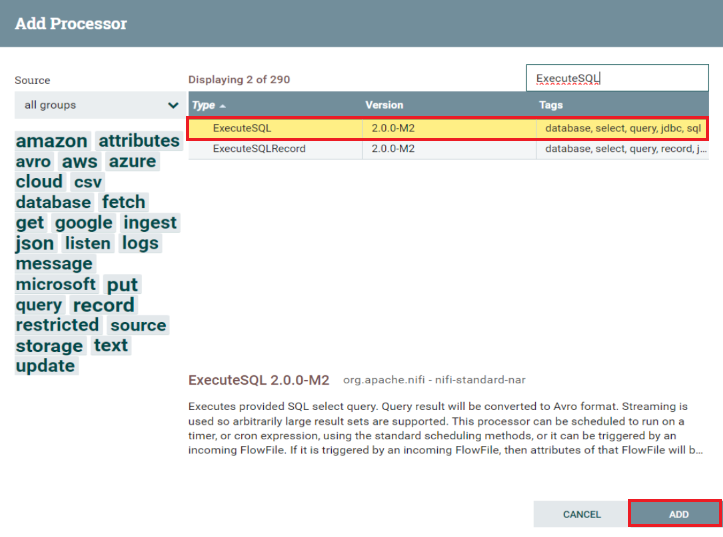

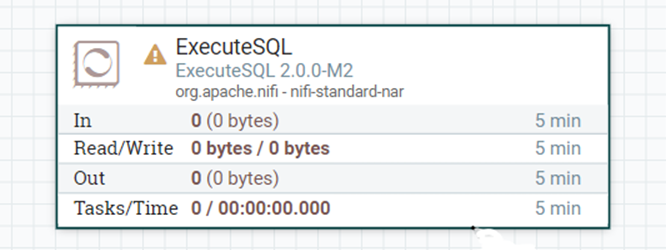

- 接続を確立し、SELECT クエリを実行するには、プロセッサー(黄色でハイライトされている部分)をワークスペースにドラッグ&ドロップします。

- 「ExecuteSQL」プロセッサーを選択し、「Add」ボタンをクリックしてワークスペースに表示させます。

- 追加したプロセッサー(ExecuteSQL)をダブルクリックして、接続ページを開きます。

- Properties セクションで、必要な情報を入力します。Database Connection Pooling Service を作成した DBCPConnectionPool に一致させ、SQL select query セクションに実行したい SQL クエリを設定してください。

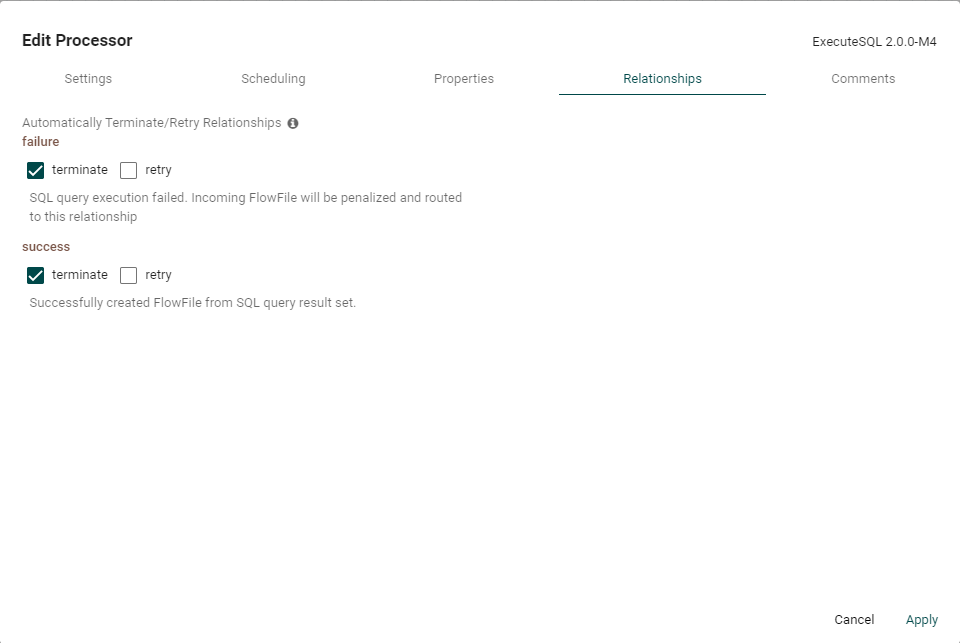

- Relationships に移動し、実行プロセスの成功時と失敗時にコンポーネントがどのように処理を進めるかのオプションを選択してください。

- ExecuteSQL コンポーネントを有効にするには、それを選択して Operation セクションの「Enable」をクリックするか、右クリックして「Enable」を選択します。

これでAzure Data Lake Storage のデータ が Apache NiFi で使用できるようになりました。たとえば、DBCPConnection Pool を QueryDatabaseTable プロセッサーのソースとして使用できます(以下に表示)。

30日間の無料トライアルをダウンロードして、Apache NiFi でリアルタイムのAzure Data Lake Storage のデータ を操作してみてください。ご不明な点は、サポートチームまでお気軽にお問い合わせください。