Apache NiFi でAmazon Athena のデータにバッチ操作を実行

Apache NiFi は、データルーティング、変換、およびシステム間連携ロジックを強力かつスケーラブルに構築できるプラットフォームです。CData JDBC Driver for Amazon Athena と組み合わせることで、NiFi からリアルタイムAmazon Athena のデータを操作できるようになります。この記事では、CSV ファイルからデータを読み取り、Apache NiFi(バージョン1.9.0 以降)でCData JDBC Driver forAmazon Athena のデータを使用してバッチ操作(INSERT/UPDATE/DELETE)を実行する方法を説明します。

最適化されたデータ処理が組み込まれたCData JDBC Driver は、リアルタイムAmazon Athena のデータを扱う上で比類のないパフォーマンスを提供します。Amazon Athena に複雑なSQL クエリを発行すると、ドライバーはフィルタや集計などのサポートされているSQL 操作をAmazon Athena に直接プッシュし、サポートされていない操作(主にSQL 関数やJOIN 操作)は組み込みSQL エンジンを利用してクライアント側で処理します。組み込みの動的メタデータクエリを使用すると、ネイティブデータ型を使ってAmazon Athena のデータを操作・分析できます。

Amazon Athena データ連携について

CData は、Amazon Athena のライブデータにアクセスし、統合するための最も簡単な方法を提供します。お客様は CData の接続機能を以下の目的で使用しています:

- IAM 認証情報、アクセスキー、インスタンスプロファイルなど、さまざまな方法で安全に認証できます。多様なセキュリティニーズに対応し、認証プロセスを簡素化します。

- 詳細なエラーメッセージにより、セットアップを効率化し、問題を迅速に解決できます。

- サーバーサイドでのクエリ実行により、パフォーマンスを向上させ、クライアントリソースへの負荷を最小限に抑えます。

ユーザーは、Tableau、Power BI、Excel などの分析ツールと Athena を統合し、お気に入りのツールから詳細な分析を行うことができます。

CData を使用した Amazon Athena のユニークなユースケースについては、ブログ記事をご覧ください:https://jp.cdata.com/blog/amazon-athena-use-cases

はじめに

JDBC URL の生成

Apache NiFi からAmazon Athena のデータに接続するには、JDBC URL が必要です。

組み込みの接続文字列デザイナー

JDBC URL の作成をサポートするために、Amazon Athena JDBC Driver に組み込まれている接続文字列デザイナーが使用できます。JAR ファイルをダブルクリックするか、コマンドラインからJAR ファイルを実行します。

java -jar cdata.jdbc.amazonathena.jar

接続プロパティを入力し、接続文字列をクリップボードにコピーします。

Amazon Athena 接続プロパティの取得・設定方法

それでは、早速Athena に接続していきましょう。

データに接続するには、以下の接続パラメータを指定します。

- DataSource:接続するAmazon Athena データソース。

- Database:接続するAmazon Athena データベース。

- AWSRegion:Amazon Athena データがホストされているリージョン。

- S3StagingDirectory:クエリの結果を保存するS3 フォルダ。

Database またはDataSource が設定されていない場合、CData 製品はAmazon Athena の利用可能なデータソースからすべてのデータベースのリスト化を試みます。そのため、両方のプロパティを設定することでCData 製品のパフォーマンスが向上します。

Amazon Athena の認証設定

CData 製品は幅広い認証オプションに対応しています。詳しくはヘルプドキュメントの「はじめに」を参照してみてください。

AWS キーを取得

IAM ユーザーの認証情報を取得するには、以下のステップお試しください。

- IAM コンソールにサインインします。

- ナビゲーションペインでユーザーを選択します。

- ユーザーのアクセスキーを作成または管理するには、ユーザーを選択してからセキュリティ認証情報タブに移動します。

AWS ルートアカウントの資格情報を取得するには、以下のステップをお試しください。

- ルートアカウントの認証情報を使用してAWS 管理コンソールにサインインします。

- アカウント名または番号を選択します。

- 表示されたメニューでMy Security Credentials を選択します。

- ルートアカウントのアクセスキーを管理または作成するには、Continue to Security Credentials をクリックし、[Access Keys]セクションを展開します。

その他の認証オプションについては、ヘルプドキュメントの「Amazon Athena への認証」を参照してください。

Apache NiFi でのバッチ操作(INSERT/UPDATE/DELETE)

以下のサンプルフローは、次のNiFi プロセッサに基づいています:

- ListFile - ローカルファイルシステムからファイルリストを取得し、取得した各ファイルにFlowFile を作成します。

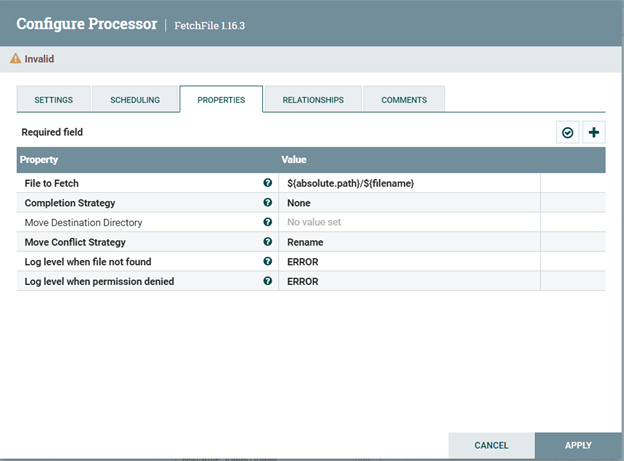

- FetchFile - ListFile プロセッサから受け取ったFlowFile のコンテンツを読み取ります。

- PutDatabaseRecord - 指定されたRecordReader を使用して、FetchFile プロセッサからのフローファイルからレコードを入力します。これらのレコードはSQL 文に変換され、単一のトランザクションとして実行されます。

- LogAttribute - 指定されたログレベルでFlowFile の属性を出力します。

完成したフローは以下のようになります:

注意事項

1. CSV ファイルのカラム名は、挿入/更新/削除するデータソーステーブルのレコードのカラム名と一致する必要があります。

2. Apache NiFi バージョン1.9.0 より前のバージョンでは、PutDatabaseRecord プロセッサの Maximum Batch Size プロパティがサポートされていません。

設定

バッチINSERT、UPDATE、またはDELETE を実行するには、NiFi プロセッサを以下のように設定します:

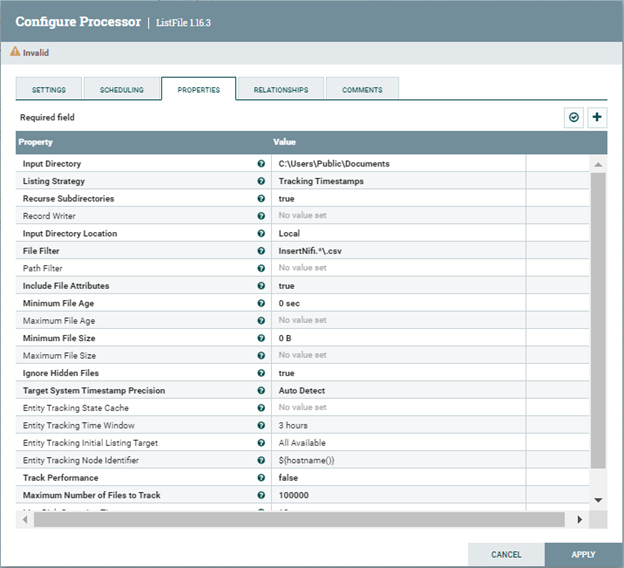

- ListFile プロセッサの設定:Input Directory プロパティを、CSV ファイルを取得するローカルフォルダパスに設定します。 File Filter プロパティを、名前が式に一致するファイルのみを選択する正規表現に設定します。 例:CSV ファイルのフルパスがC:\Users\Public\Documents\InsertNiFi.csv の場合、プロパティは以下の画像のように設定します:

- FetchFile プロセッサの設定 FetchFile プロセッサのプロパティ設定はデフォルト値のままにします:

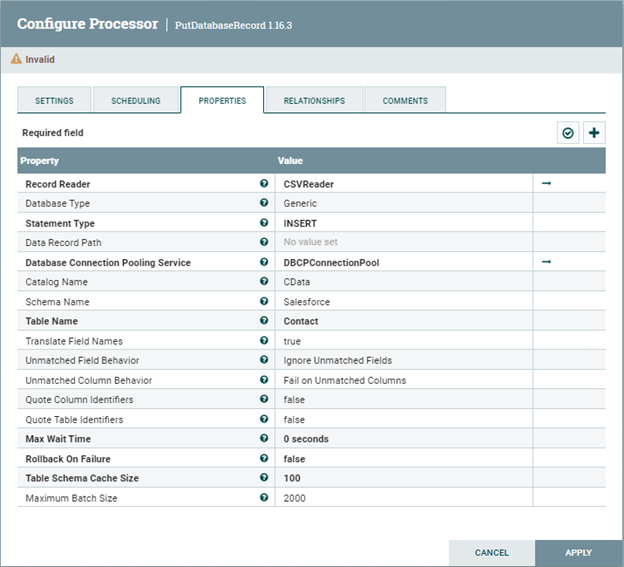

- PutDatabaseRecord プロセッサの設定

- Record Reader プロパティをCSV Reader Controller Service に設定します。CSV Reader Controller Service を、CSV ファイルの形式に合わせて設定します。

- Statement Type プロパティをINSERT に設定します。

-

Database Connection Pooling Service を、ドライバー設定を保持するDBCPConnection Pool に設定します。ドライバーはBulk API を使用するように設定する必要があります。

プロパティ 値 Database Connection URL jdbc:amazonathena:AccessKey='a123';SecretKey='s123';Region='IRELAND';Database='sampledb';S3StagingDirectory='s3://bucket/staging/'; Database Driver Class Name cdata.jdbc.amazonathena.AmazonAthenaDriver - Catalog Name プロパティを、テーブルが属するカタログの名前に設定します。

- Schema Name プロパティを、テーブルが属するスキーマの名前に設定します。

- Table Name プロパティを、INSERT 先のテーブル名に設定します。

-

Maximum Batch Size プロパティを、単一のバッチに含めるレコードの最大数に設定します。

-

Record Reader プロパティをCSV Reader Controller Service に設定します。CSV Reader Controller Service を、CSV ファイルの形式に合わせて設定します。

- Statement Type プロパティをUPDATE に設定します。

- Database Connection Pooling Service を、ドライバー設定を保持するDBCPConnection Pool に設定します。ドライバーはBulk API を使用するように設定する必要があります。上記と同じDatabase Connection URL 形式を使用します。

- Catalog Name プロパティを、テーブルが属するカタログの名前に設定します。

- Schema Name プロパティを、テーブルが属するスキーマの名前に設定します。

- Table Name プロパティを、UPDATE 対象のテーブル名に設定します。

- Update Keys プロパティを、UPDATE に必要なカラム名に設定します。

-

Maximum Batch Size プロパティを、単一のバッチに含めるレコードの最大数に設定します。

-

Record Reader プロパティをCSV Reader Controller Service に設定します。CSV Reader Controller Service を、CSV ファイルの形式に合わせて設定します。

- Statement Type プロパティをDELETE に設定します。

- Database Connection Pooling Service を、ドライバー設定を保持するDBCPConnection Pool に設定します。ドライバーはBulk API を使用するように設定する必要があります。上記と同じDatabase Connection URL 形式を使用します。

- Catalog Name プロパティを、テーブルが属するカタログの名前に設定します。

- Schema Name プロパティを、テーブルが属するスキーマの名前に設定します。

- Table Name プロパティを、UPDATE 対象のテーブル名に設定します。

- INSERT やUPDATE のStatement Type とは異なり、DELETE 操作ではMaximum Batch Size プロパティは表示されません。ただし、操作は引き続きバッチで処理されます。変更しない場合、バッチあたりの最大レコード数はデフォルト値の2000 です。DELETE 操作で使用するMaximum Batch Size の値を変更するには、Statement Type をINSERT またはUPDATE に変更し、Maximum Batch Size プロパティの値を変更して「Apply Changes」をクリックします。最後に、プロセッサの設定を再度開き、Statement Type をDELETE に戻して「Apply Changes」をクリックします。

-

LogAttribute プロセッサの設定

最後に、LogAttribute プロセッサを設定して、ユースケースに基づいてログに記録または無視する属性とログレベルを指定します。

INSERT 操作

バッチINSERT 操作を実行するには、PutDatabaseRecord プロセッサを以下のように設定します:

UPDATE 操作

バッチUPDATE 操作を実行するには、PutDatabaseRecord プロセッサを以下のように設定します:

DELETE 操作

バッチDELETE 操作を実行するには、PutDatabaseRecord プロセッサを以下のように設定します:

無償トライアルと詳細情報

CData JDBC Driver for Amazon Athena の30日間無償トライアルをダウンロードして、Apache NiFi でリアルタイムAmazon Athena のデータの操作をはじめましょう。ご不明な点があれば、サポートチームにお問い合わせください。