Apache Airflow で Amazon Athena データを連携

Apache Airflow は、データエンジニアリングワークフローの作成、スケジューリング、モニタリングをサポートするツールです。 CData JDBC Driver for Amazon Athena と組み合わせることで、Airflow からリアルタイムの Amazon Athena のデータ を扱うことができます。 この記事では、Apache Airflow インスタンスから Amazon Athena のデータ に接続してクエリを実行し、結果を CSV ファイルに保存する方法を説明します。

CData JDBC ドライバーは、最適化されたデータ処理機能を組み込んでおり、 リアルタイムの Amazon Athena のデータ を扱う際に比類のないパフォーマンスを発揮します。複雑な SQL クエリを Amazon Athena に発行すると、 ドライバーはフィルタや集計などのサポートされている SQL 操作を直接 Amazon Athena にプッシュし、 サポートされていない操作(主に SQL 関数や JOIN 操作)は組み込みの SQL エンジンを使用してクライアント側で処理します。 また、組み込みの動的メタデータクエリ機能により、ネイティブのデータ型を使用して Amazon Athena のデータ の操作・分析が可能です。

Amazon Athena データ連携について

CData は、Amazon Athena のライブデータにアクセスし、統合するための最も簡単な方法を提供します。お客様は CData の接続機能を以下の目的で使用しています:

- IAM 認証情報、アクセスキー、インスタンスプロファイルなど、さまざまな方法で安全に認証できます。多様なセキュリティニーズに対応し、認証プロセスを簡素化します。

- 詳細なエラーメッセージにより、セットアップを効率化し、問題を迅速に解決できます。

- サーバーサイドでのクエリ実行により、パフォーマンスを向上させ、クライアントリソースへの負荷を最小限に抑えます。

ユーザーは、Tableau、Power BI、Excel などの分析ツールと Athena を統合し、お気に入りのツールから詳細な分析を行うことができます。

CData を使用した Amazon Athena のユニークなユースケースについては、ブログ記事をご覧ください:https://jp.cdata.com/blog/amazon-athena-use-cases

はじめに

Amazon Athena への接続を設定

組み込みの接続文字列デザイナー

JDBC URL の構築には、Amazon Athena JDBC Driver に組み込まれている接続文字列デザイナーを使用できます。JAR ファイルをダブルクリックするか、コマンドラインから JAR ファイルを実行してください。

java -jar cdata.jdbc.amazonathena.jar

接続プロパティを入力し、接続文字列をクリップボードにコピーします。

Amazon Athena 接続プロパティの取得・設定方法

それでは、早速Athena に接続していきましょう。

データに接続するには、以下の接続パラメータを指定します。

- DataSource:接続するAmazon Athena データソース。

- Database:接続するAmazon Athena データベース。

- AWSRegion:Amazon Athena データがホストされているリージョン。

- S3StagingDirectory:クエリの結果を保存するS3 フォルダ。

Database またはDataSource が設定されていない場合、CData 製品はAmazon Athena の利用可能なデータソースからすべてのデータベースのリスト化を試みます。そのため、両方のプロパティを設定することでCData 製品のパフォーマンスが向上します。

Amazon Athena の認証設定

CData 製品は幅広い認証オプションに対応しています。詳しくはヘルプドキュメントの「はじめに」を参照してみてください。

AWS キーを取得

IAM ユーザーの認証情報を取得するには、以下のステップお試しください。

- IAM コンソールにサインインします。

- ナビゲーションペインでユーザーを選択します。

- ユーザーのアクセスキーを作成または管理するには、ユーザーを選択してからセキュリティ認証情報タブに移動します。

AWS ルートアカウントの資格情報を取得するには、以下のステップをお試しください。

- ルートアカウントの認証情報を使用してAWS 管理コンソールにサインインします。

- アカウント名または番号を選択します。

- 表示されたメニューでMy Security Credentials を選択します。

- ルートアカウントのアクセスキーを管理または作成するには、Continue to Security Credentials をクリックし、[Access Keys]セクションを展開します。

その他の認証オプションについては、ヘルプドキュメントの「Amazon Athena への認証」を参照してください。

クラスター環境やクラウドで JDBC ドライバーをホストする場合は、ライセンス(製品版またはトライアル版)とランタイムキー(RTK)が必要です。ライセンス(またはトライアル)の取得については、弊社営業チームにお問い合わせください。

以下は、JDBC 接続に必要な主なプロパティです。

| プロパティ | 値 |

|---|---|

| データベース接続 URL | jdbc:amazonathena:RTK=5246...;AccessKey='a123';SecretKey='s123';Region='IRELAND';Database='sampledb';S3StagingDirectory='s3://bucket/staging/'; |

| データベースドライバークラス名 | cdata.jdbc.amazonathena.AmazonAthenaDriver |

Airflow で JDBC 接続を設定

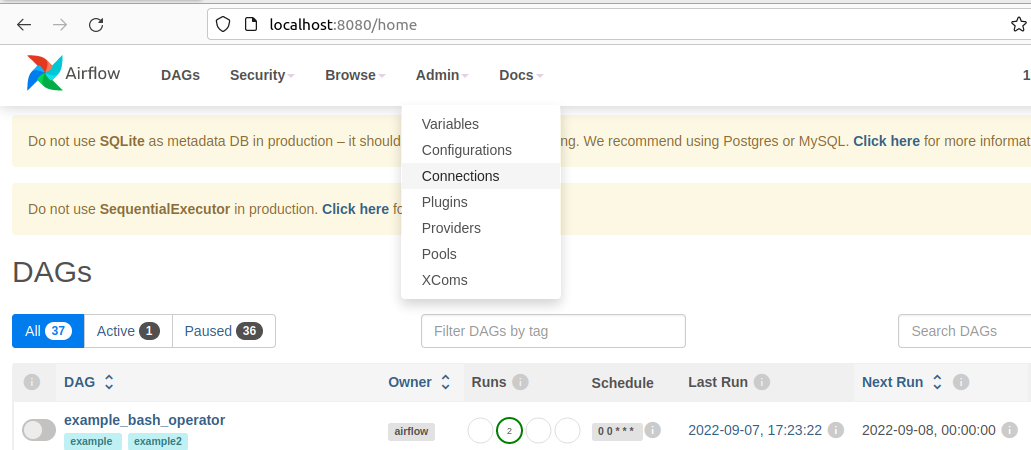

- Apache Airflow インスタンスにログインします。

- Airflow インスタンスのナビゲーションバーで、Admin にカーソルを合わせ、Connections をクリックします。

- 次の画面で + ボタンをクリックして、新しい接続を作成します。

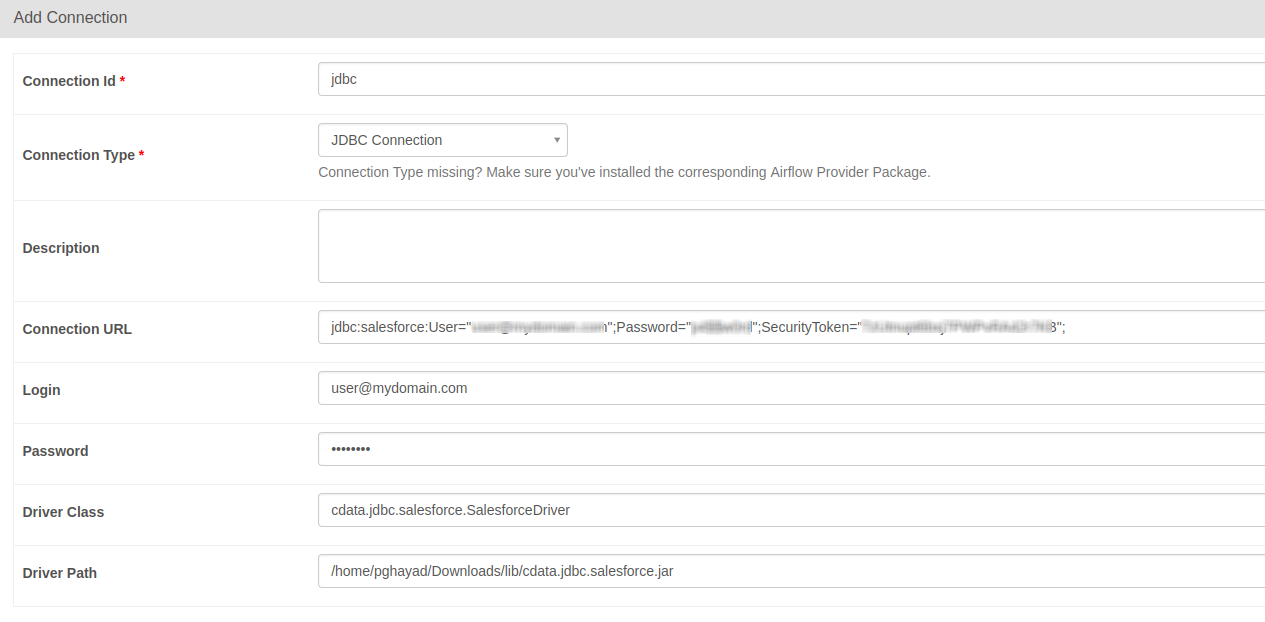

- Add Connection フォームで、必要な接続プロパティを入力します:

- Connection Id:接続の名前を入力します(例:amazonathena_jdbc)

- Connection Type:JDBC Connection

- Connection URL:上記の JDBC 接続 URL(例:jdbc:amazonathena:RTK=5246...;AccessKey='a123';SecretKey='s123';Region='IRELAND';Database='sampledb';S3StagingDirectory='s3://bucket/staging/';)

- Driver Class:cdata.jdbc.amazonathena.AmazonAthenaDriver

- Driver Path:PATH/TO/cdata.jdbc.amazonathena.jar

- フォーム下部の Test ボタンをクリックして、新しい接続をテストします。

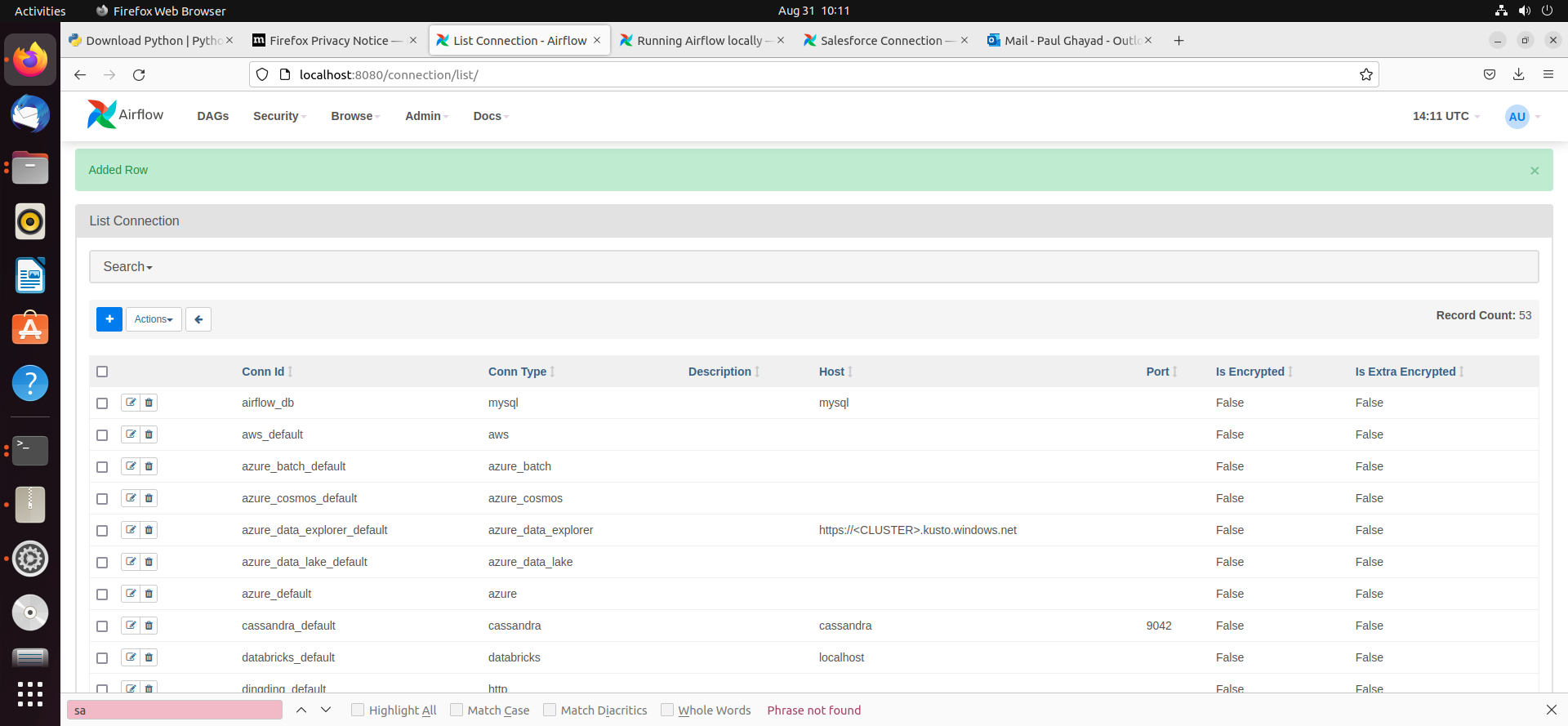

- 新しい接続を保存すると、次の画面で接続リストに新しい行が追加されたことを示す緑色のバナーが表示されます。

DAG の作成

Airflow の DAG は、ワークフローのプロセスを保存し、トリガーすることでワークフローを実行できるエンティティです。 ここでのワークフローは、Amazon Athena のデータ に対して SQL クエリを実行し、結果を CSV ファイルに保存するというシンプルなものです。

- まず、ホームディレクトリに「airflow」フォルダがあるはずです。その中に「dags」という新しいディレクトリを作成します。 ここに Python ファイルを保存すると、UI 上で Airflow DAG として表示されます。

- 次に、新しい Python ファイルを作成し、amazon athena_hook.py という名前を付けます。このファイルに以下のコードを挿入してください:

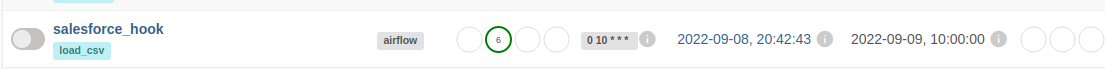

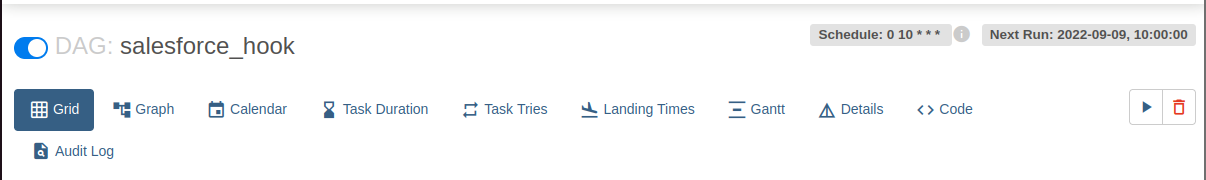

import time from datetime import datetime from airflow.decorators import dag, task from airflow.providers.jdbc.hooks.jdbc import JdbcHook import pandas as pd # DAG を宣言 @dag(dag_id="amazon athena_hook", schedule_interval="0 10 * * *", start_date=datetime(2022,2,15), catchup=False, tags=['load_csv']) # DAG 関数を定義 def extract_and_load(): # タスクを定義 @task() def jdbc_extract(): try: hook = JdbcHook(jdbc_conn_id="jdbc") sql = """ select * from Account """ df = hook.get_pandas_df(sql) df.to_csv("/{some_file_path}/{name_of_csv}.csv",header=False, index=False, quoting=1) # print(df.head()) print(df) tbl_dict = df.to_dict('dict') return tbl_dict except Exception as e: print("Data extract error: " + str(e)) jdbc_extract() sf_extract_and_load = extract_and_load() - このファイルを保存し、Airflow インスタンスを更新します。DAG のリストに「amazon athena_hook」という新しい DAG が表示されるはずです。

- この DAG をクリックし、次の画面で一時停止スイッチをクリックして青色にオンにします。次に、トリガー(再生)ボタンをクリックして DAG を実行します。これにより、amazon athena_hook.py ファイル内の SQL クエリが実行され、コード内で指定したファイルパスに CSV として結果がエクスポートされます。

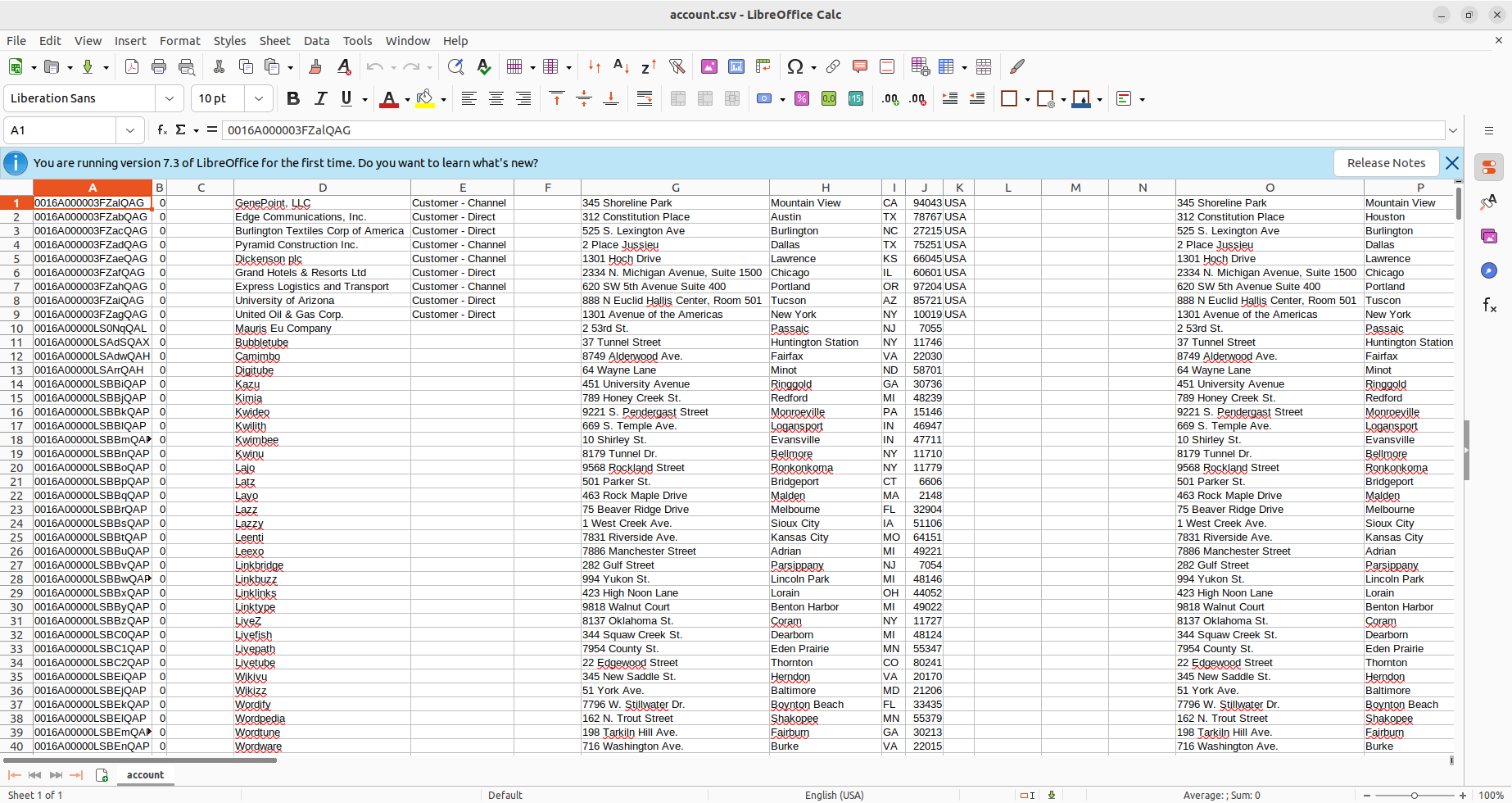

- 新しい DAG をトリガーした後、Downloads フォルダ(または Python スクリプト内で指定した場所)を確認すると、CSV ファイルが作成されていることがわかります。この例では account.csv です。

- CSV ファイルを開くと、Apache Airflow によって Amazon Athena のデータ が CSV 形式で利用可能になっていることを確認できます。