Adobe Target のデータをApache Kafka トピックにストリーミング

Apache Kafka は、主にリアルタイムデータパイプラインやイベント駆動型アプリケーションの構築に使用されるオープンソースのストリーム処理プラットフォームです。CData JDBC Driver for Adobe Targetと組み合わせることで、Kafka はライブのAdobe Target のデータを扱うことができます。この記事では、Adobe Target データをApache Kafka トピックに接続、アクセス、ストリーミングする方法と、Confluent Control Center を起動してConfluent プラットフォームのKafka インフラストラクチャを使用して受信したAdobe Target のデータをユーザーが安全に管理および監視できるようにする方法について説明します。

CData JDBC Driver は最適化されたデータ処理機能を内蔵しており、ライブのAdobe Target のデータとのやり取りにおいて比類のないパフォーマンスを提供します。Adobe Target に複雑なSQL クエリを発行すると、ドライバーはフィルタや集計などのサポートされているSQL 操作を直接Adobe Target にプッシュし、サポートされていない操作(多くの場合SQL 関数やJOIN 操作)については組み込みのSQL エンジンを使用してクライアント側で処理します。組み込みの動的メタデータクエリにより、ネイティブのデータ型を使用してAdobe Target のデータを操作および分析できます。

前提条件

Apache Kafka トピックでAdobe Target のデータをストリーミングするためにCData JDBC Driver を接続する前に、クライアントのLinux ベースのシステムに以下をインストールおよび設定してください。

- Confluent Platform for Apache Kafka

- Confluent Hub CLI のインストール

- Confluent Platform 用のSelf-Managed Kafka JDBC Source Connector

Adobe Target のデータへの新しいJDBC 接続を定義

- Linux ベースのシステムにCData JDBC Driver for Adobe Targetをダウンロードします。

- 以下の手順に従って新しいディレクトリを作成し、すべてのドライバーの内容を展開します:

- Adobe Target という名前の新しいディレクトリを作成します。

mkdir AdobeTarget

- ダウンロードしたドライバーファイル(.zip)をこの新しいディレクトリに移動します。

mv AdobeTargetJDBCDriver.zip AdobeTarget/

- CData AdobeTargetJDBCDriver の内容をこの新しいディレクトリに解凍します。

unzip AdobeTargetJDBCDriver.zip

- Adobe Target という名前の新しいディレクトリを作成します。

- Adobe Target ディレクトリを開き、lib フォルダに移動します。

ls cd lib/

- CData JDBC Driver for Adobe Target のlib フォルダの内容をKafka Connect JDBC のlib フォルダにコピーします。Kafka Connect JDBC フォルダの内容を確認し、cdata.jdbc.adobetarget.jar ファイルがlib フォルダに正常にコピーされたことを確認します。

cp -r /path/to/CData JDBC Driver for Adobe Target/lib/* /usr/share/confluent-hub-components/confluentinc-kafka-connect-jdbc/lib/ cd /usr/share/confluent-hub-components/confluentinc-kafka-connect-jdbc/lib/

- 以下のコマンドを使用して、CData Adobe Target JDBC ドライバーのライセンスをインストールします。名前とメールアドレスを入力してください。

java -jar cdata.jdbc.adobetarget.jar -l

- プロダクトキーまたは"TRIAL" を入力します(ライセンスの有効期限が切れた場合は、CData サポートチームまでお問い合わせください)。

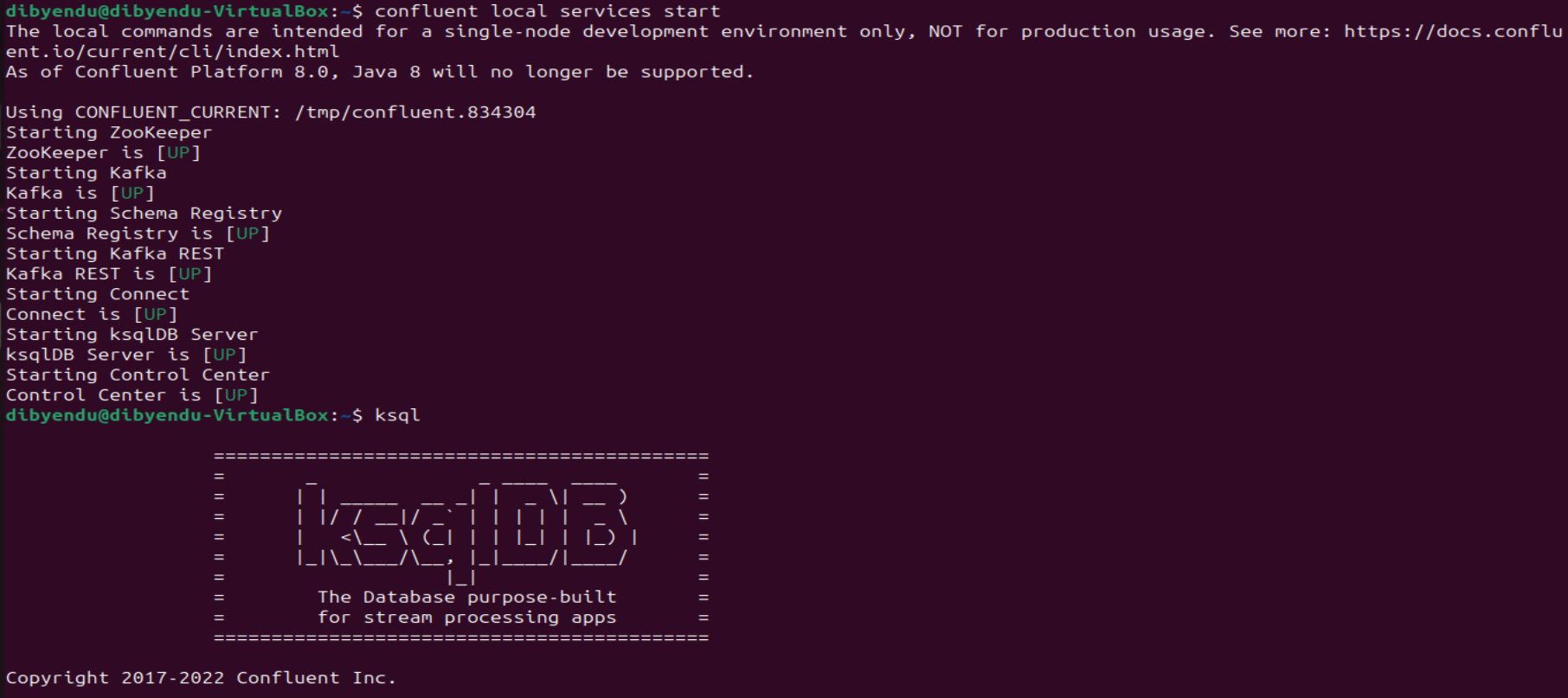

- 以下のコマンドを使用してConfluent ローカルサービスを起動します:

confluent local services start

これにより、Zookeeper、Kafka、Schema Registry、Kafka REST、Kafka CONNECT、ksqlDB、Control Center などのすべてのConfluent サービスが起動します。これで、CData JDBC Driver for Adobe Target を使用してKafka Connect Driver 経由でksqlDB のKafka トピックにメッセージをストリーミングする準備が整いました。

- POST HTTP API リクエストを使用してKafka トピックを手動で作成します:

curl --location 'server_address:8083/connectors' --header 'Content-Type: application/json' --data '{ "name": "jdbc_source_cdata_adobetarget_01", "config": { "connector.class": "io.confluent.connect.jdbc.JdbcSourceConnector", "connection.url": "jdbc:adobetarget:Tenant=mycompanyname;", "topic.prefix": "adobetarget-01-", "mode": "bulk" } }'HTTP POST 本文(上記)で使用されるフィールドについて説明します:

- connector.class: 使用するKafka Connect コネクタのJava クラスを指定します。

- connection.url: Adobe Target データに接続するためのJDBC 接続URL です。

組み込みの接続文字列デザイナー

JDBC URL の作成については、CData JDBC Driver for Adobe Targetに組み込まれた接続文字列デザイナーを使用してください。JAR ファイルをダブルクリックするか、コマンドラインからjar ファイルを実行します。

java -jar cdata.jdbc.adobetarget.jar

接続プロパティを入力し、接続文字列をクリップボードにコピーします。

Adobe Target に接続するには、以下に記載されているOAuth 接続プロパティとともにTenant プロパティを指定する必要があります。他の接続プロパティは処理動作に影響を与える可能性がありますが、接続には影響しません。

以下のステップでTenant 名を確認できます。

- Adobe Experience にログインします。URL は「https://experience.adobe.com/#/@mycompanyname/preferences/general-section」です。

- 「/#/@」の後の値を抽出します。この例では「mycompanyname」です。

- Tenant 接続プロパティをその値に設定します。

ユーザーアカウント(OAuth)

すべてのユーザーアカウントフローでAuthScheme をOAuthClient に設定する必要があります。

注意:OAuth を介したAdobe 認証では、2週間ごとにトークンを更新する必要があります。

すべてのアプリケーション

CData では、OAuth 認証を簡素化する組み込みOAuth アプリケーションを提供しています。または、カスタムOAuth アプリケーションを作成することもできます。詳細については、ヘルプドキュメントの「カスタムOAuthアプリの作成」をご確認ください。OAuth アクセストークンの取得

接続するには以下のプロパティを設定します:

- InitiateOAuth:GETANDREFRESH に設定して、OAuth 交換を自動的に実行し、必要に応じてOAuthAccessToken を更新します。

- OAuthClientId:アプリを登録した際に割り当てられたクライアントID に設定します。

- OAuthClientSecret:アプリを登録した際に割り当てられたクライアントシークレットに設定します。

- CallbackURL:アプリを登録した際に定義されたリダイレクトURI に設定します。例:https://localhost:3333

これらの設定により、プロバイダーはAdobe Target からアクセストークンを取得し、それを使用してデータを要求します。OAuth値はOAuthSettingsLocation で指定された場所に保存され、接続間で確実に保持されます。

- topic.prefix: コネクタによって作成されるKafka トピックに追加されるプレフィックスです。「adobetarget-01-」に設定されています。

- mode: コネクタの動作モードを指定します。ここでは「bulk」に設定されており、コネクタがバルクデータ転送を実行するように設定されていることを示しています。

このリクエストにより、Adobe Target のすべてのテーブル/コンテンツがKafka トピックとして追加されます。

注意: リクエストをPOST するIP アドレス(サーバー)は、Linux ネットワークのIP アドレスです。

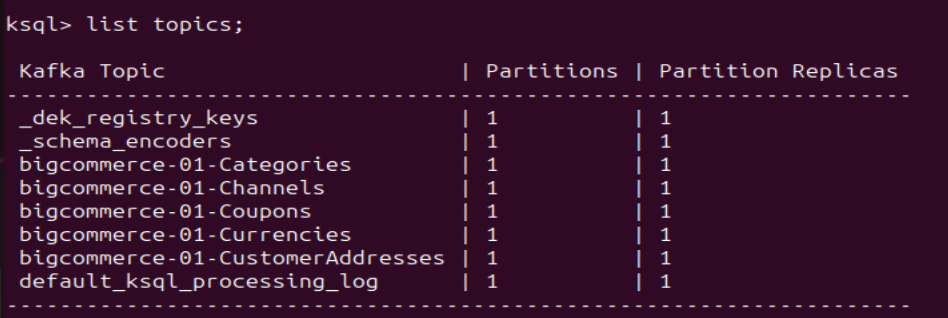

- ksqlDB を実行し、トピックを一覧表示します。以下のコマンドを使用します:

ksql list topics;

- トピック内のデータを表示するには、以下のSQL ステートメントを入力します:

PRINT topic FROM BEGINNING;

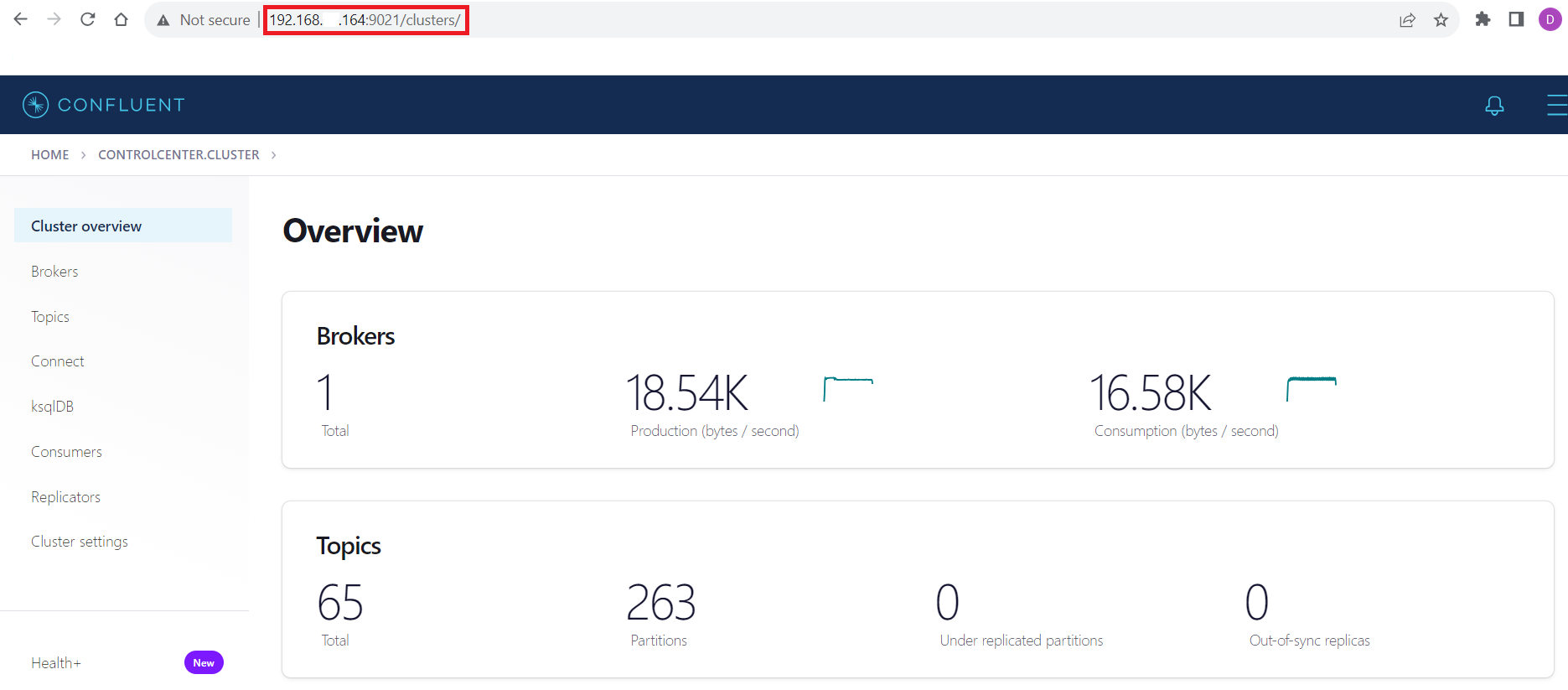

Confluent Control Center への接続

Confluent Control Center のユーザーインターフェースにアクセスするには、上記のセクションで説明した"confluent local services" を実行し、ローカルブラウザでhttp://<server address>:9021/clusters/ と入力してください。

おわりに

CData JDBC Driver for Adobe Targetの30日間無償トライアルをダウンロードして、Adobe Target データをApache Kafka にストリーミングしましょう。ご不明な点があれば、サポートチームまでお問い合わせください。